このサイトのオーナーはエレキギターを弾くので, オーナー個人的には, オーディオプログラミングの最大の楽しみはエフェクターを実装することだと思っています.

エフェクター実装の基本

一方で, 抽象化されているがゆえに, Web Audio API でエフェクターを実装する場合に理解しておくべきことが 2 つあります.

LFO (Low Frequency Oscillator) の実装

AudioParam への接続

LFO (Low Frequency Oscillator)

エフェクターにはいくつかの種類があり, モジュレーション系と呼ばれるエフェクター (コーラス, フランジャー, フェイザー, トレモロ, ワウなど)

を実装するためには, 特定のパラメータを時間経過とともに周期的に変化させる必要があります . 具体的には, コーラス / フランジャーは,

ディレイタイム (遅延時間) を時間経過とともに周期的に変化させることによって実装可能です. そして,

特定のパラメータを時間経過とともに周期的に変化させる機能が LFO (Low Frequency Oscillator ) です.

LFO の実装は Web Audio API に限ったことではないのですが, OscillatorNode を利用して LFO を実装する場合には, Web Audio API

特有のことをもう 1 つ理解している必要があります. それが, AudioParam への接続です.

AudioParam への接続

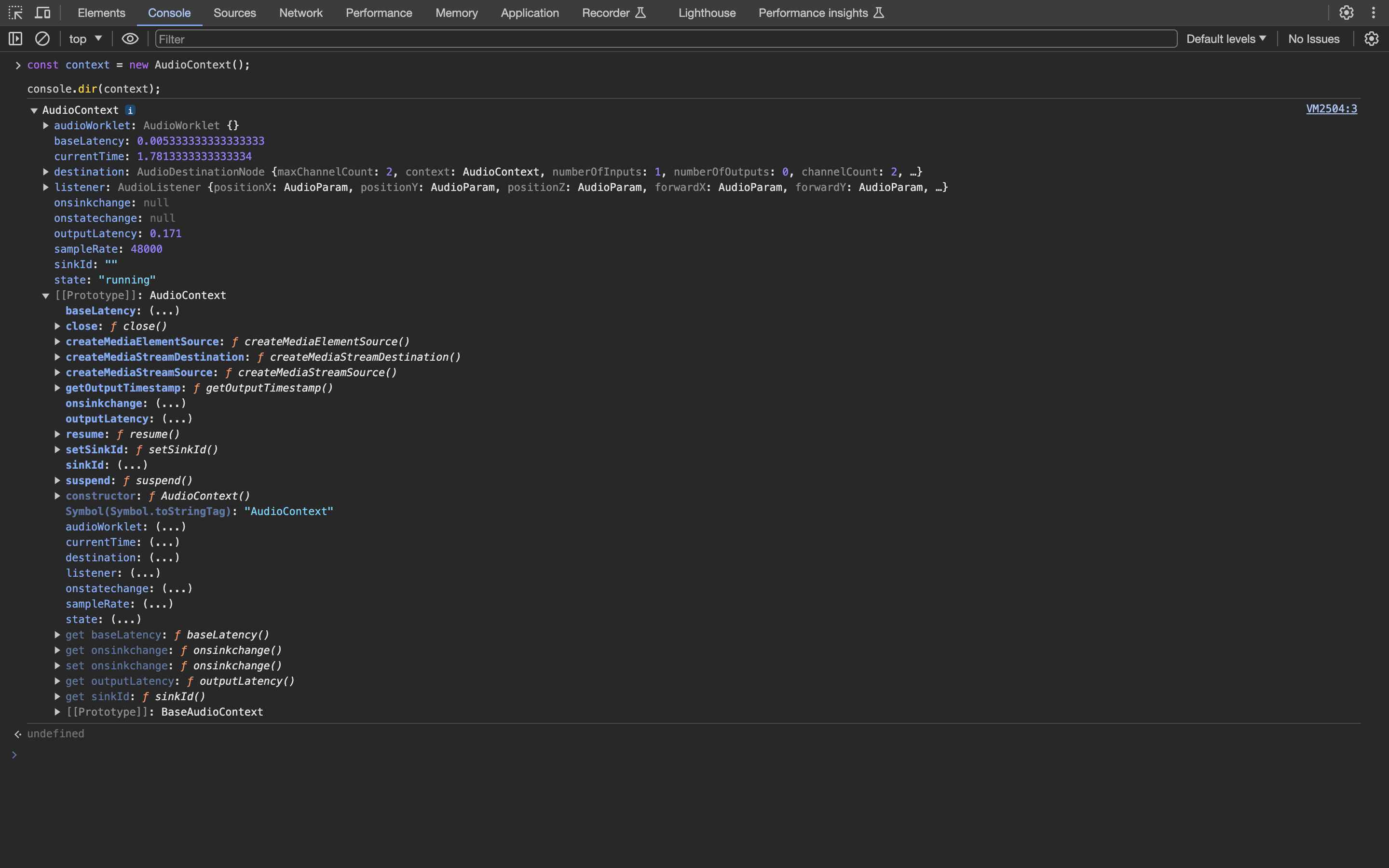

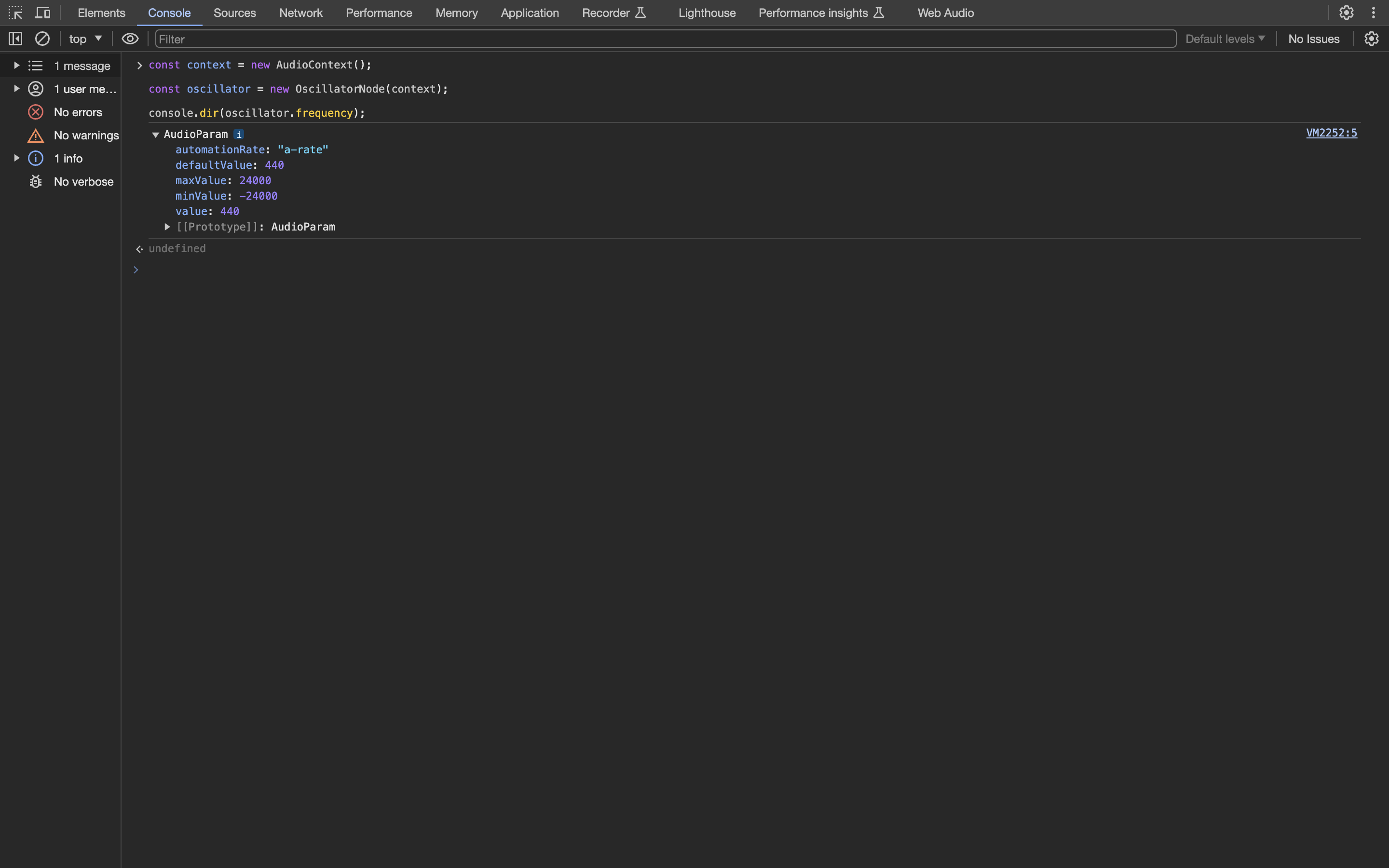

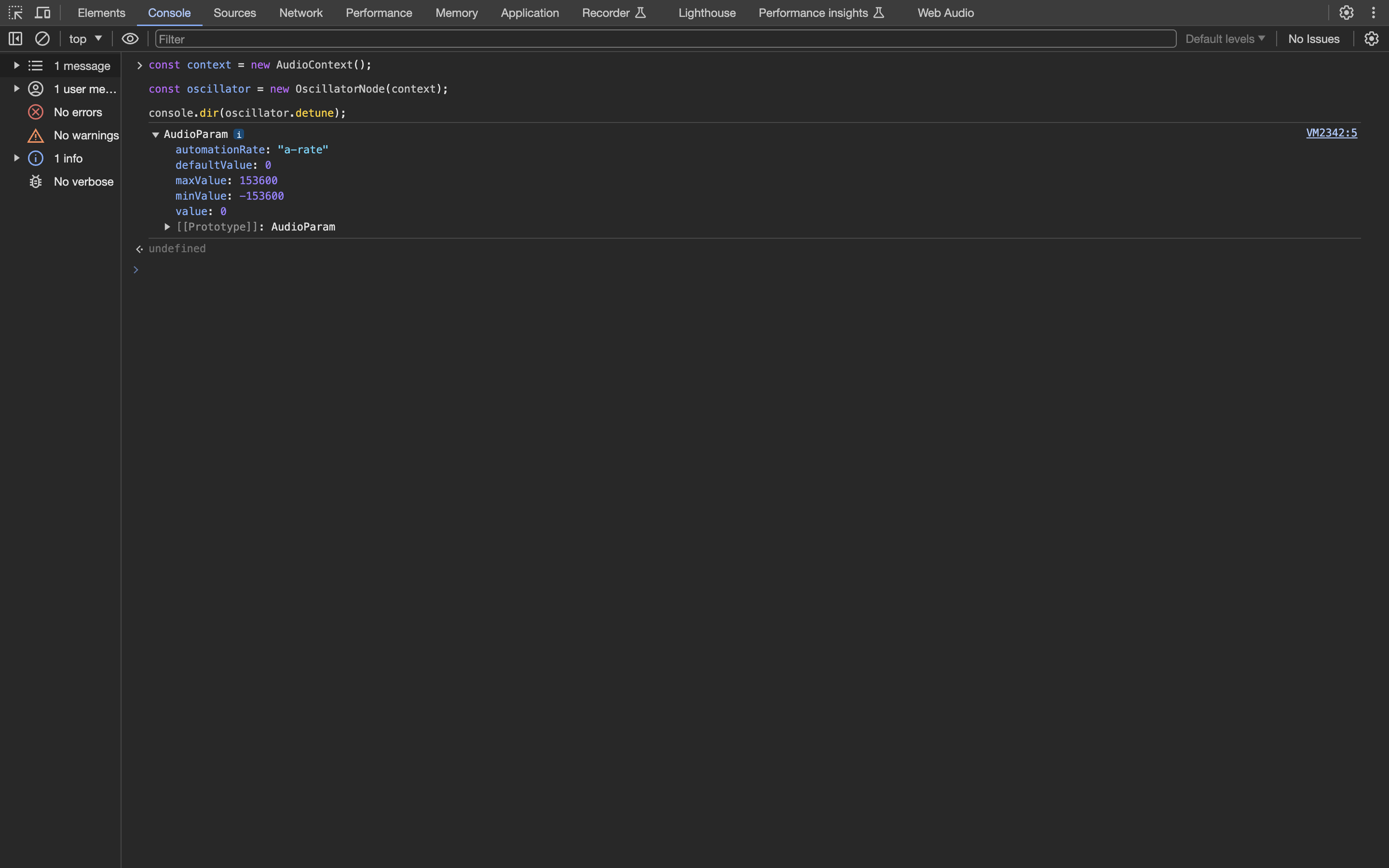

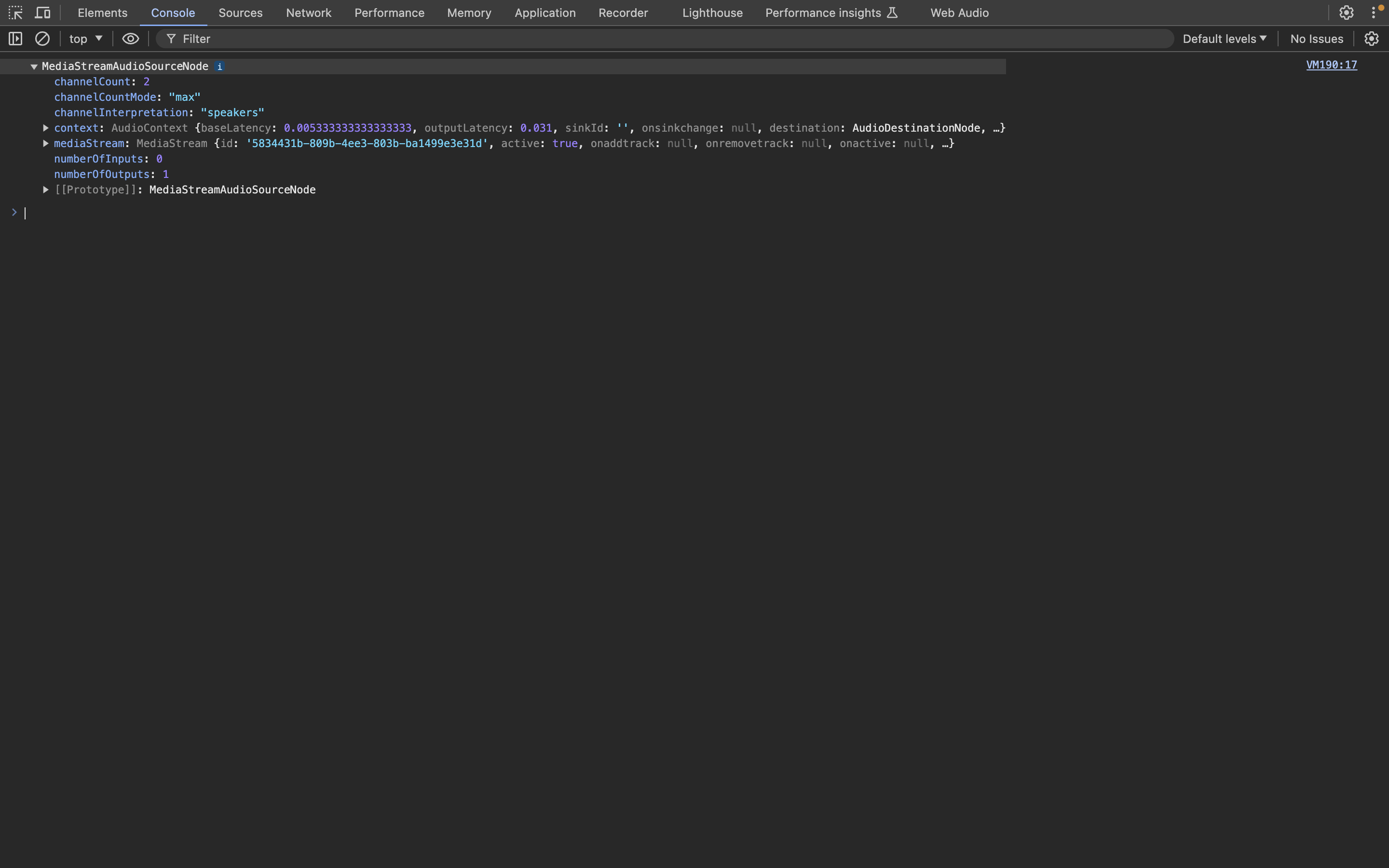

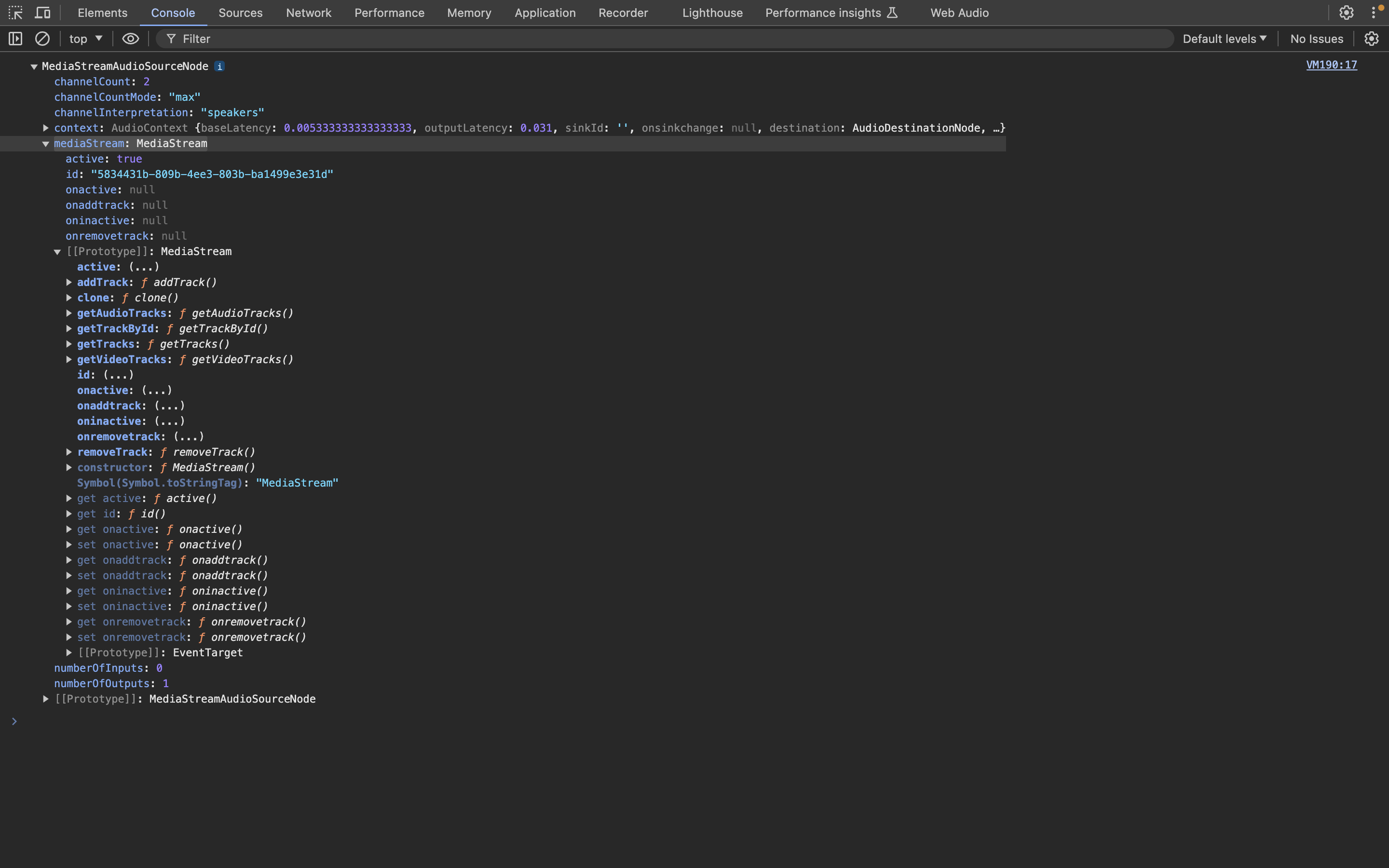

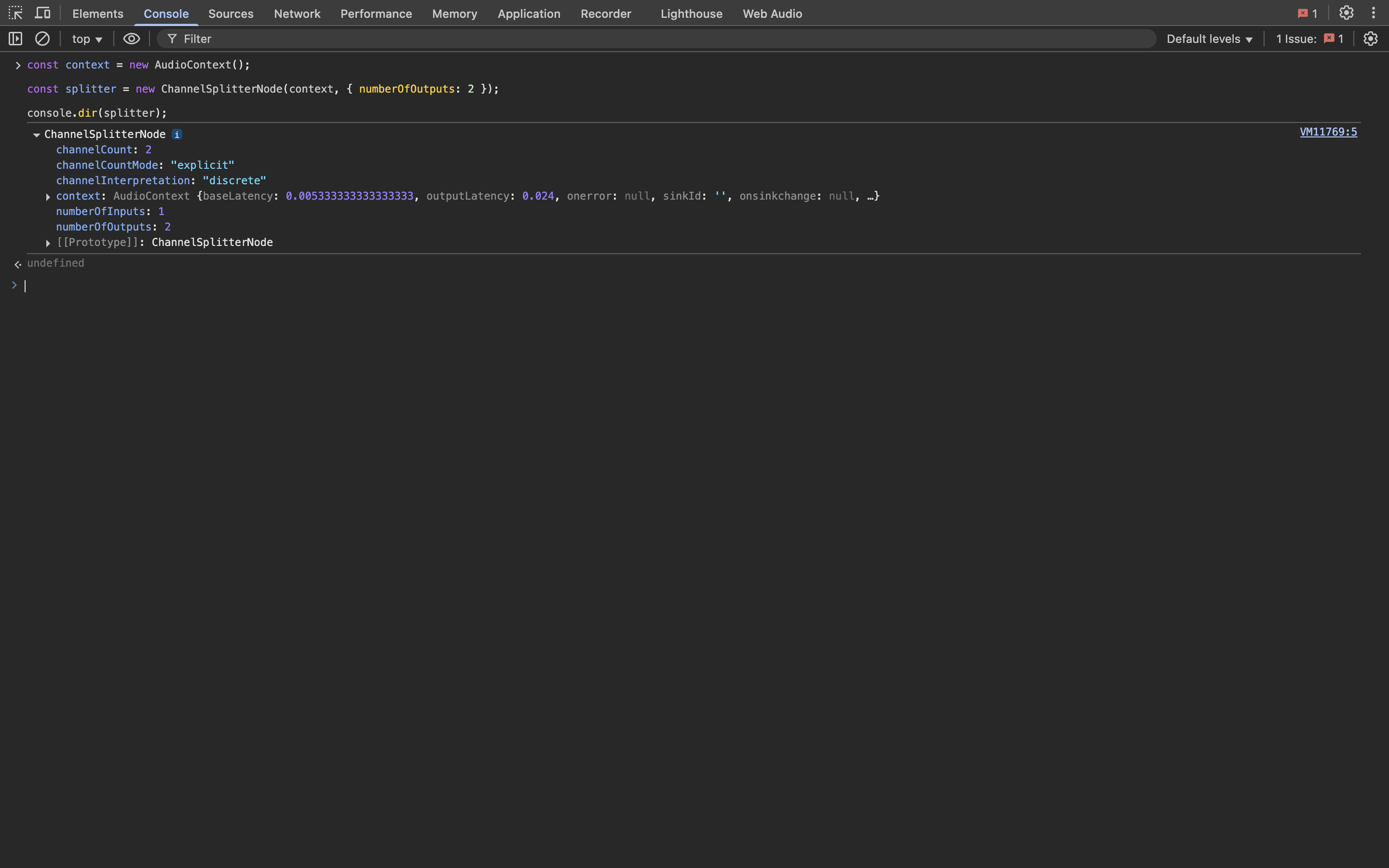

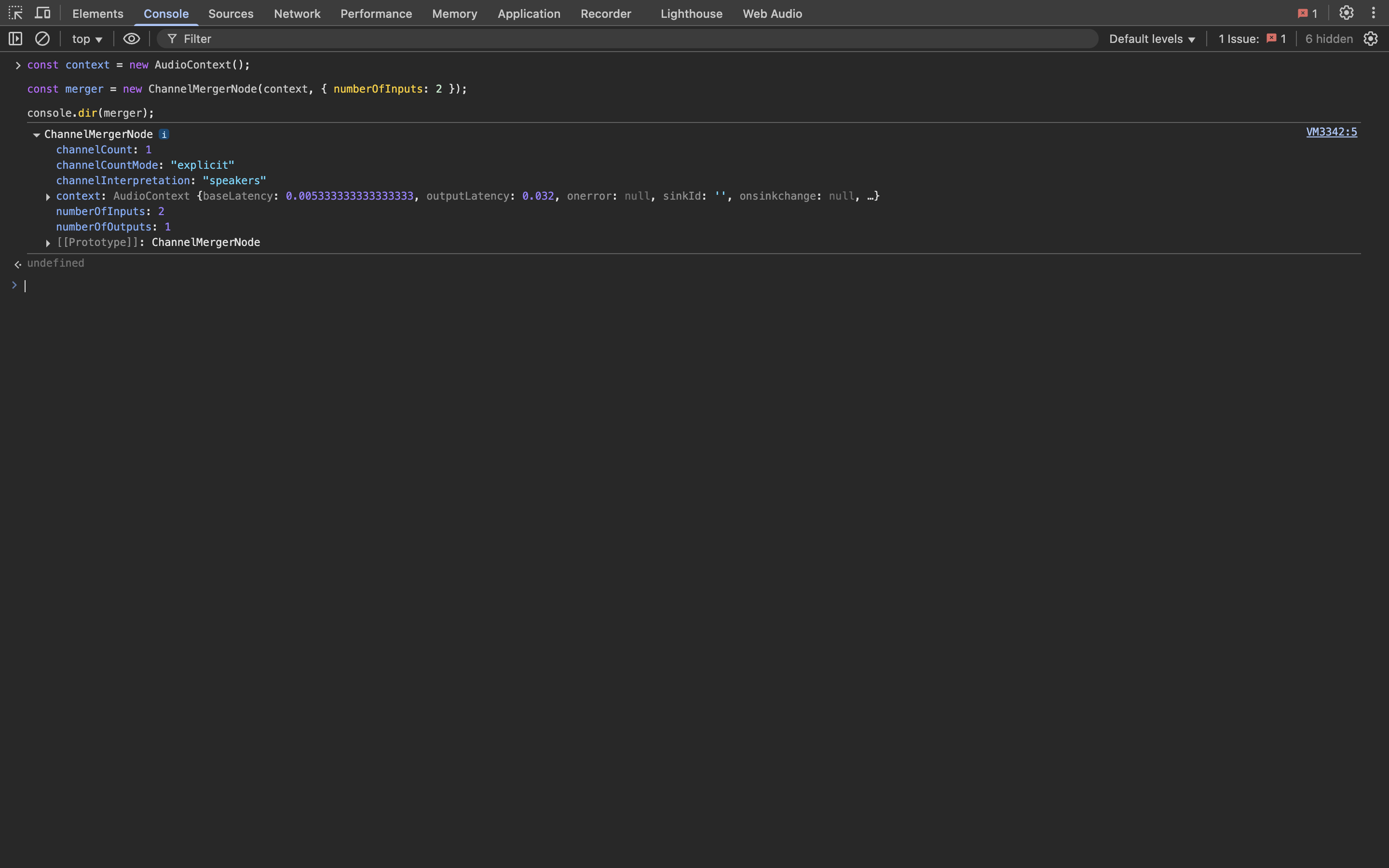

結論から記載すると, AudioNode の connect メソッドはオーバーロードされており, 第 1 引数には

AudioNode インスタンスだけでなく, AudioParam インスタンスを指定することも可能です. すなわち,

OscillatorNode の接続先を AudioParam にすることで,

対象のパラメータを時間経過とともに周期的に変化させることが可能になります.

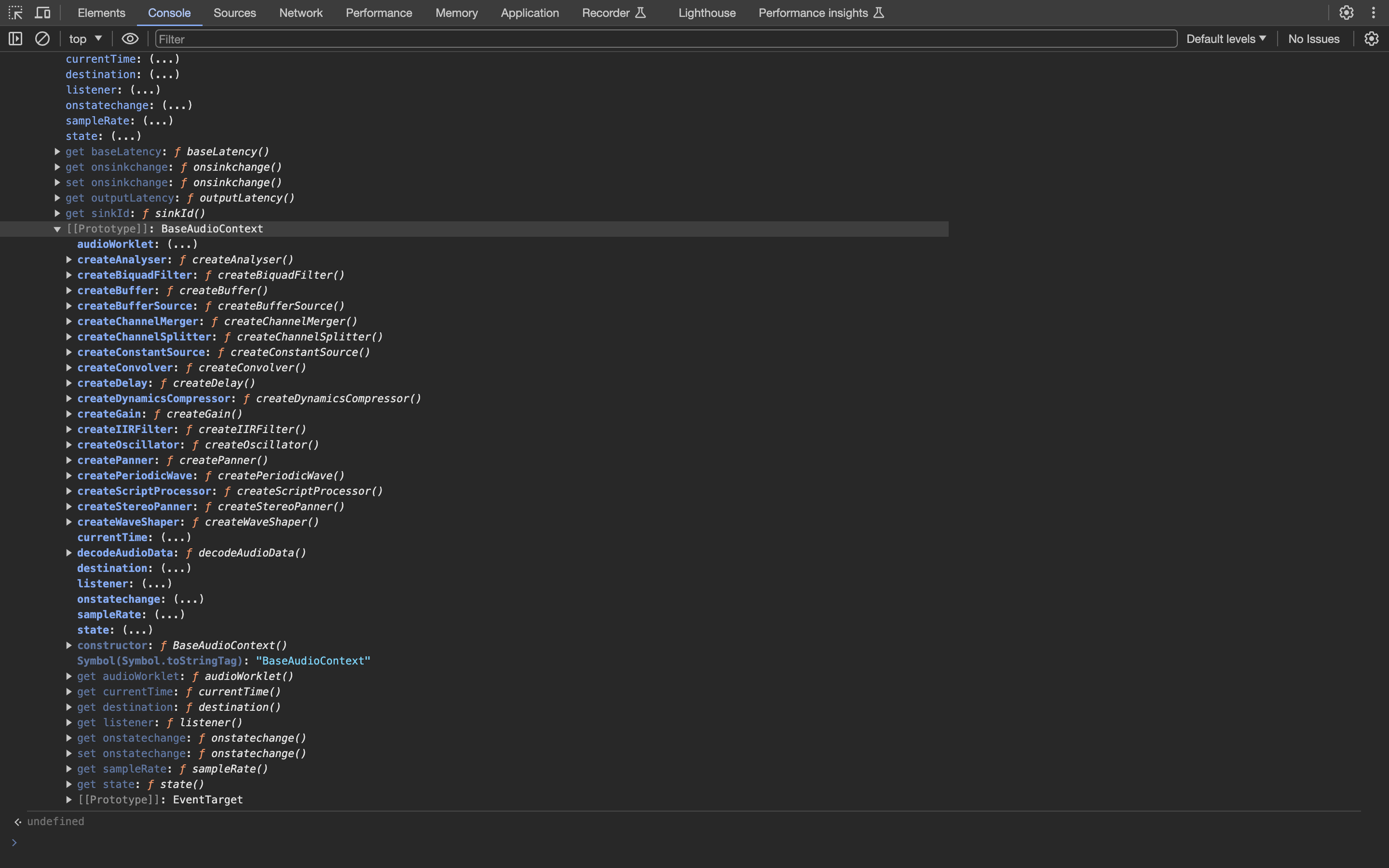

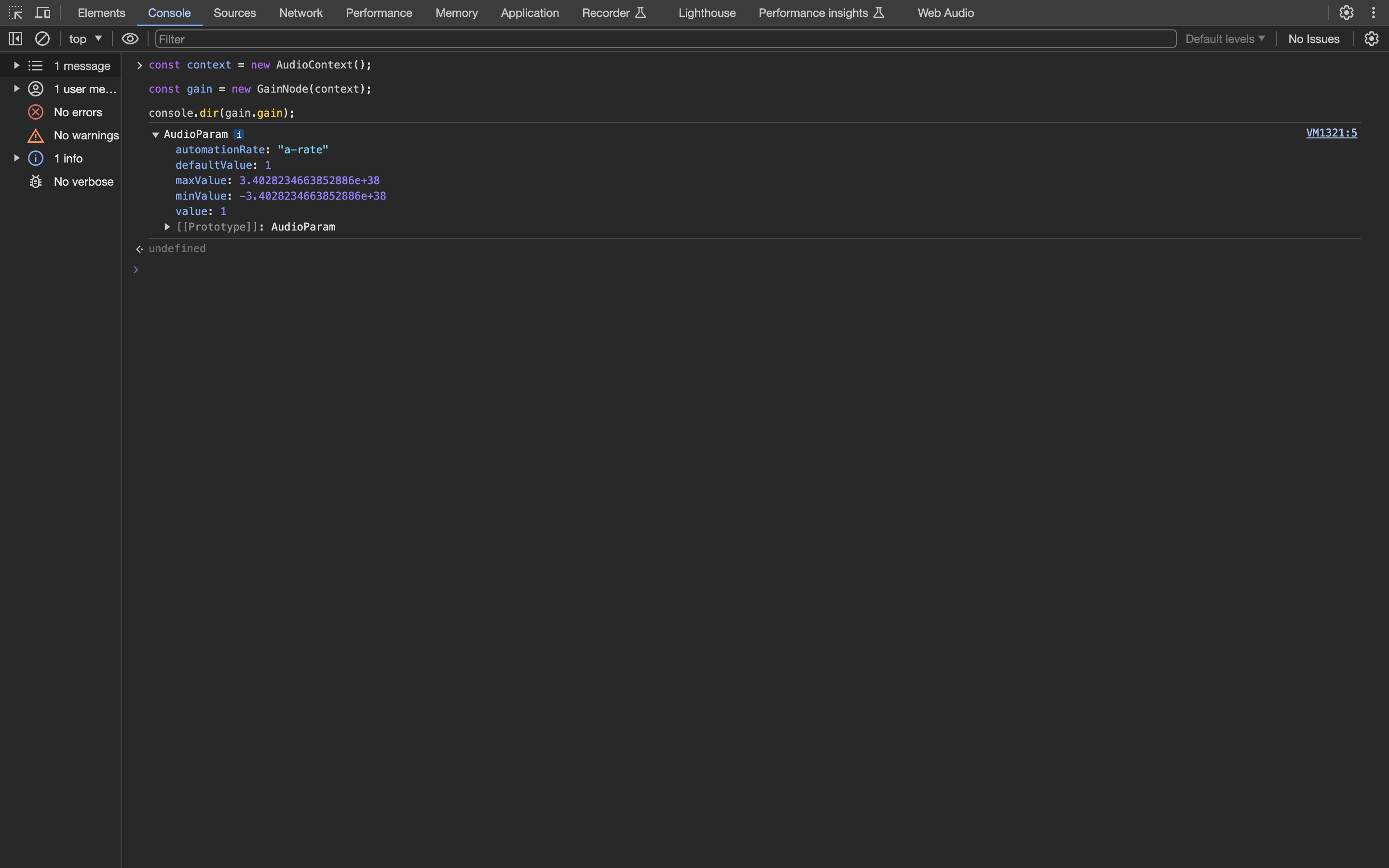

また, LFO のソースとなる OscillatorNode に GainNode を接続することで, パラメータの変化量を調整することが可能になります.

一般的なエフェクターのパラメータの, Depth は GainNode の gain プロパティの値に, Rate は

OscillatorNode の frequency プロパティの値と detune プロパティの値に相当しますプロパティの値に相当します.

LFO の実装例 (ビブラート)

LFO と AudioParam への接続, Depth / Rate の制御を具体的に理解するために, 簡易的なビブラートを実装を記載します. (OscillatorNode

の frequency プロパティのデフォルト値である) 440 Hz を基準に, Depth で設定した値が Rate の周期で変化することになります.

初期値で言うと, 440 Hz ± 10 Hz の範囲で, frequency プロパティの値が,

1 sec の間に変化することになります.

<button type="button">start</button>

<label for="range-lfo-depth">Depth</label>

<input type="range" id="range-lfo-depth" value="10" min="0" max="50" step="1" />

<span id="print-lfo-depth-value">10</span>

<label for="range-lfo-rate">Rate</label>

<input type="range" id="range-lfo-rate" value="1" min="1" max="10" step="1" />

<span id="print-lfo-rate-value">1</span>const context = new AudioContext();

let oscillator = null;

let lfo = null;

let depth = null;

let depthValue = 10;

let rateValue = 1;

const buttonElement = document.querySelector('button[type="button"]');

const rangeDepthElement = document.getElementById('range-lfo-depth');

const rangeRateElement = document.getElementById('range-lfo-rate');

const spanPrintDepthElement = document.getElementById('print-lfo-depth-value');

const spanPrintRateElement = document.getElementById('print-lfo-rate-value');

buttonElement.addEventListener('mousedown', (event) => {

if ((oscillator !== null) || (lfo !== null)) {

return;

}

oscillator = new OscillatorNode(context, { frequency: 440 });

lfo = new OscillatorNode(context, { frequency: rateValue });

depth = new GainNode(context, { gain: depthValue });

// OscillatorNode (Input) -> AudioDestinationNode (Output)

oscillator.connect(context.destination);

// OscillatorNode (LFO) -> GainNode (Depth) -> OscillatorNode.frequency (AudioParam)

// 440 Hz +- ${depthValue} Hz

lfo.connect(depth);

depth.connect(oscillator.frequency);

// Start immediately

oscillator.start(0);

// Start LFO

lfo.start(0);

buttonElement.textContent = 'stop';

});

buttonElement.addEventListener('mouseup', (event) => {

if ((oscillator === null) || (lfo === null)) {

return;

}

// Stop immediately

oscillator.stop(0);

lfo.stop(0);

// GC (Garbage Collection)

oscillator = null;

lfo = null;

depth = null;

buttonElement.textContent = 'start';

});

rangeDepthElement.addEventListener('input', (event) => {

depthValue = event.currentTarget.valueAsNumber;

if (depth) {

depth.gain.value = depthValue;

}

spanPrintDepthElement.textContent = Math.trunc(depthValue).toString(10);

});

rangeRateElement.addEventListener('input', (event) => {

rateValue = event.currentTarget.valueAsNumber;

if (lfo) {

lfo.frequency.value = rateValue;

}

spanPrintRateElement.textContent = Math.trunc(rateValue).toString(10);

});

汎用的な LFO と Depth の制御

基準値と Depth の関係から, パラメータ変化の最小値を考慮しておく必要があるのは, LFO の実装として汎用性に欠けます (先ほどのビブラートの実装だと,

基準値を 27.5 Hz にした場合, Depth の値によっては, 負数の周波数になってしまいます). より汎用的な LFO にするために,

パラメータの変化量を直接 Depth に設定するのではなく, 基準値に対する変化割合を格納する変数を追加して, その比率と基準値から実際の Depth

を算出します. このような実装にすることで, 基準値に関わらず, Depth の値は 0 から 1 (0 % から

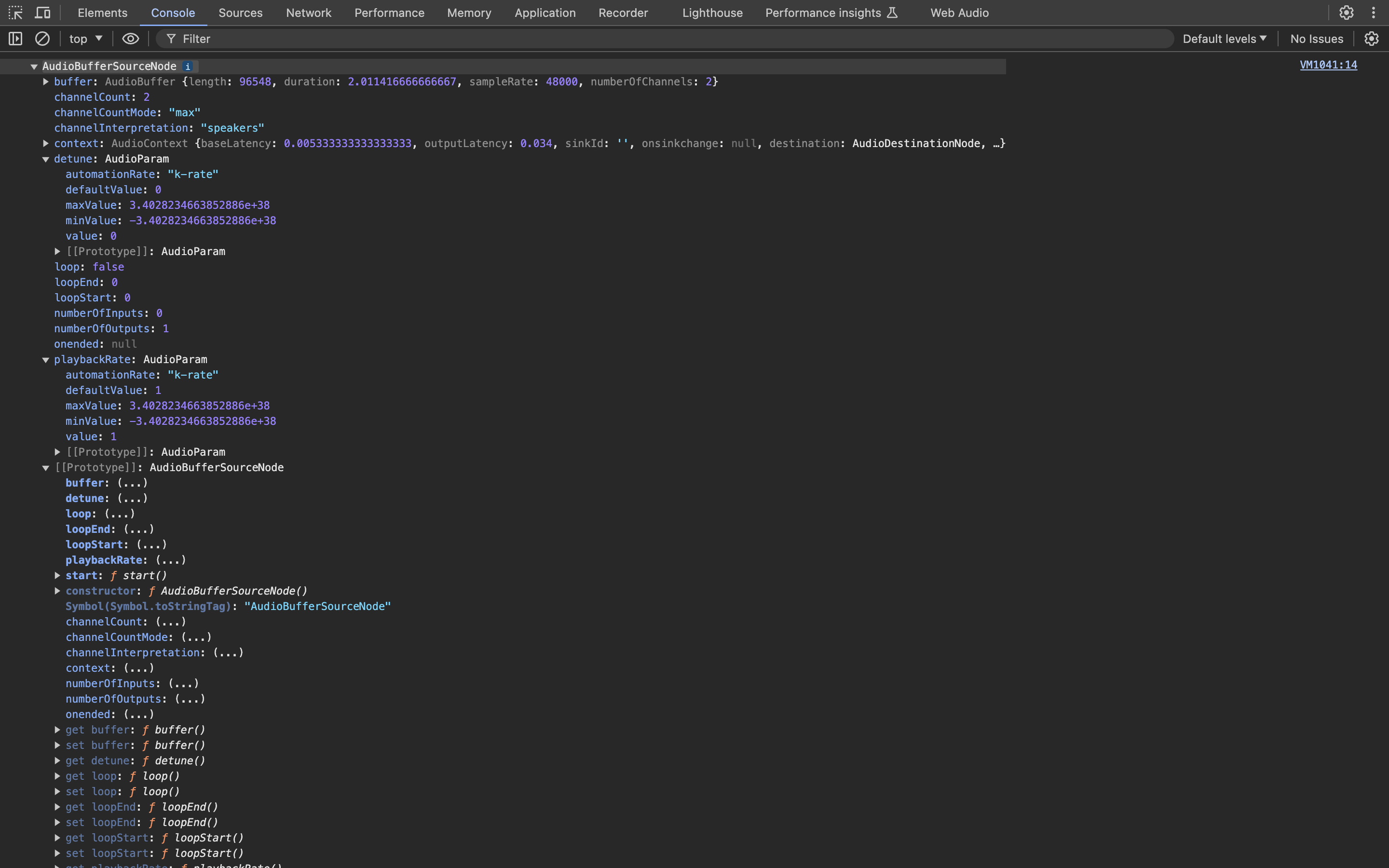

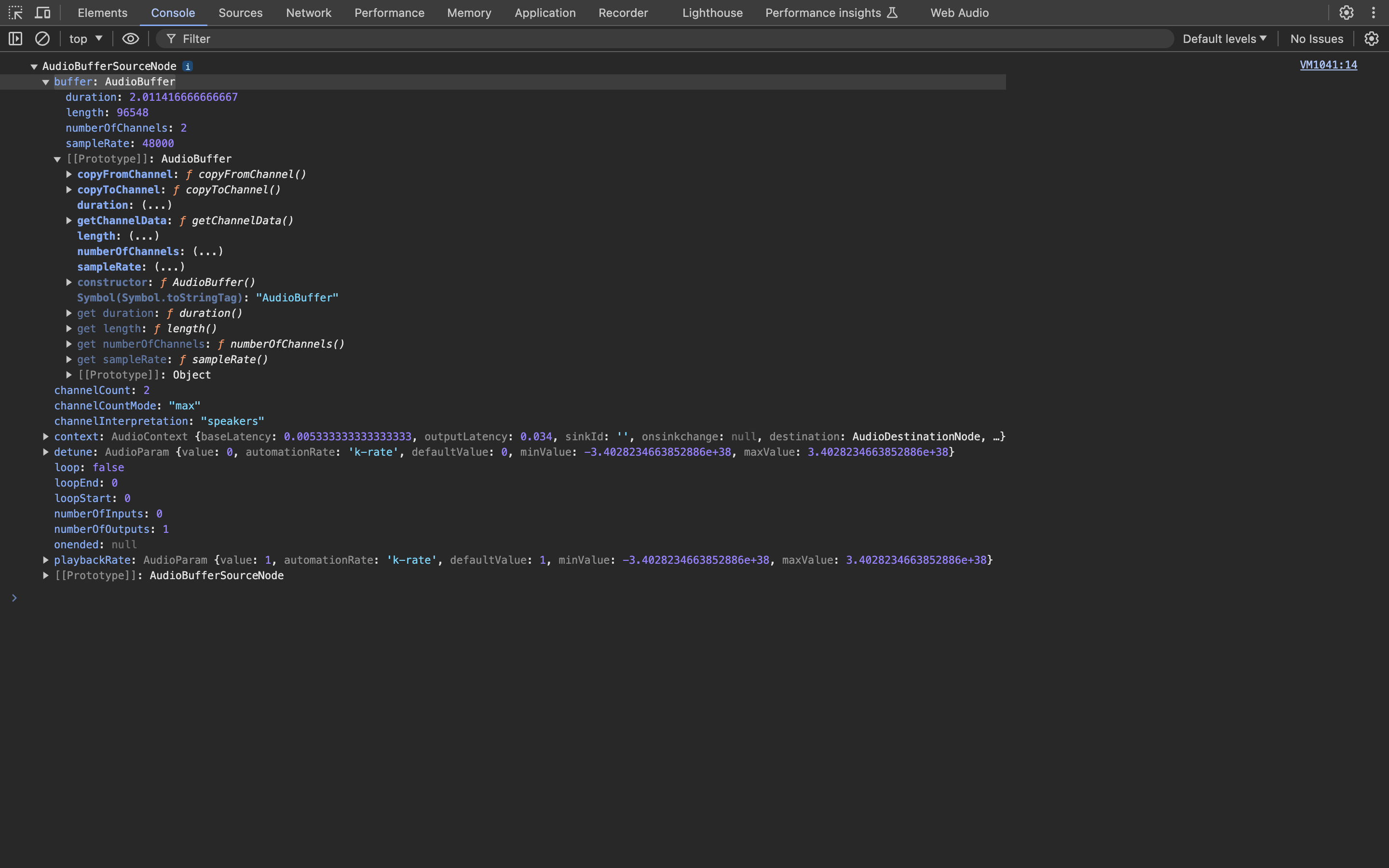

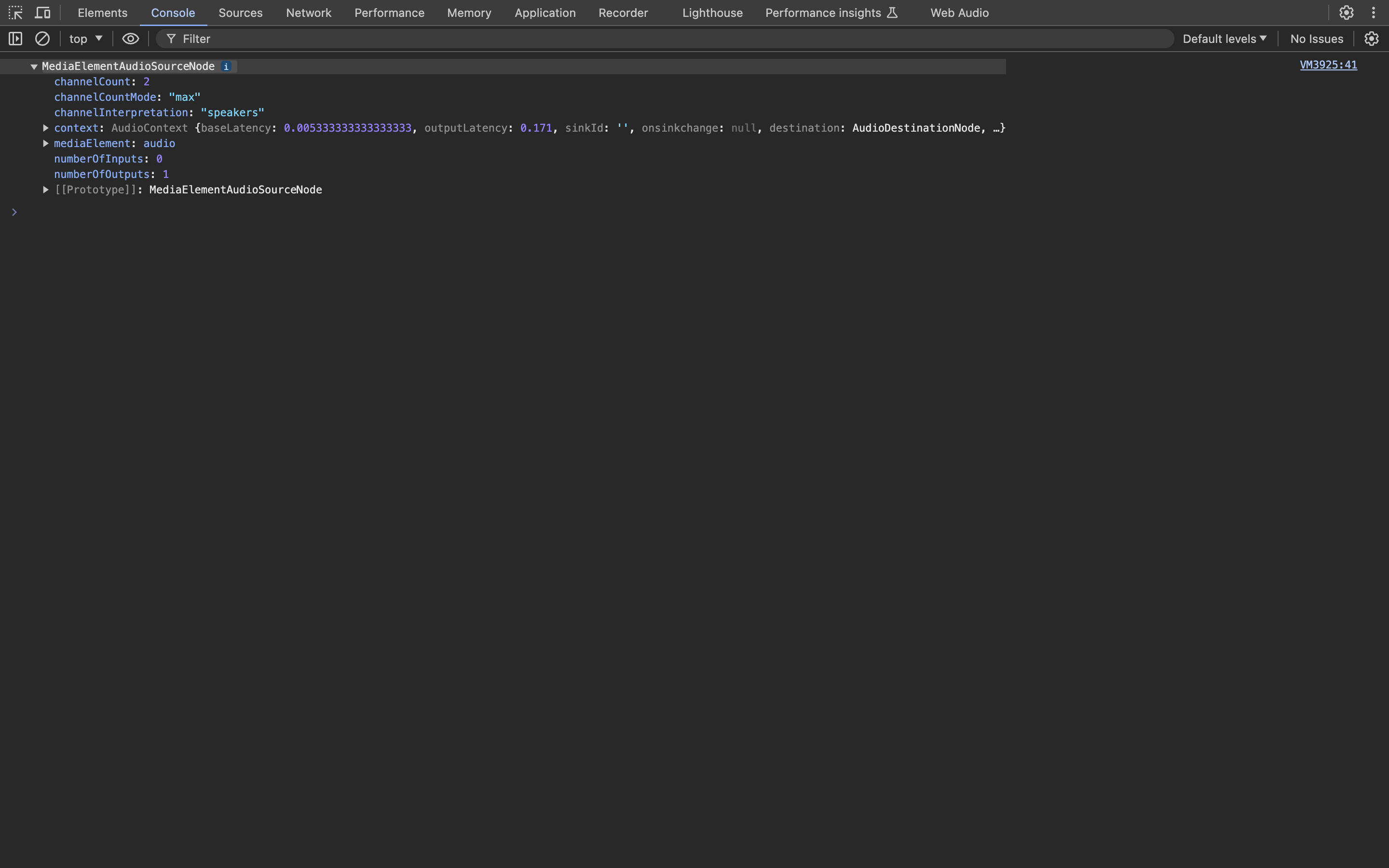

100 %) になるのでより汎用的な実装になります, また, 各 AudioParam のパラメータの値の範囲 (AudioParam の

minValue / maxValue プロパティにそれぞれ, 最小値と最大値が設定されています)

を意図せずに超えてしまうバグも防ぐことができます.

start

OscillatorNode frequency

440 Hz

Depth

0.1

Rate

1

<button type="button">start</button>

<label for="range-oscillator-frequency">OscillatorNode frequency</label>

<input type="range" id="range-oscillator-frequency" value="440" min="27.5" max="4000" step="0.5" />

<span id="print-oscillator-frequency-value">440</span>

<label for="range-lfo-depth">Depth</label>

<input type="range" id="range-lfo-depth" value="0.1" min="0" max="1" step="0.05" />

<span id="print-lfo-depth-value">10</span>

<label for="range-lfo-rate">Rate</label>

<input type="range" id="range-lfo-rate" value="1" min="1" max="10" step="1" />

<span id="print-lfo-rate-value">1</span>const context = new AudioContext();

let oscillator = null;

let lfo = null;

let depth = null;

let frequency = 440;

let depthRate = 0.1;

let rateValue = 1;

const buttonElement = document.querySelector('button[type="button"]');

const rangeFrequencyElement = document.getElementById('range-oscillator-frequency');

const rangeDepthElement = document.getElementById('range-lfo-depth');

const rangeRateElement = document.getElementById('range-lfo-rate');

const spanPrintFrequencyElement = document.getElementById('print-oscillator-frequency-value');

const spanPrintDepthElement = document.getElementById('print-lfo-depth-value');

const spanPrintRateElement = document.getElementById('print-lfo-rate-value');

buttonElement.addEventListener('mousedown', (event) => {

if ((oscillator !== null) || (lfo !== null)) {

return;

}

oscillator = new OscillatorNode(context, { frequency });

lfo = new OscillatorNode(context, { frequency: rateValue });

depth = new GainNode(context, { gain: oscillator.frequency.value * depthRate });

// OscillatorNode (Input) -> AudioDestinationNode (Output)

oscillator.connect(context.destination);

// OscillatorNode (LFO) -> GainNode (Depth) -> OscillatorNode.frequency (AudioParam)

lfo.connect(depth);

depth.connect(oscillator.frequency);

// Start immediately

oscillator.start(0);

// Start LFO

lfo.start(0);

buttonElement.textContent = 'stop';

});

buttonElement.addEventListener('mouseup', (event) => {

if ((oscillator === null) || (lfo === null)) {

return;

}

// Stop immediately

oscillator.stop(0);

lfo.stop(0);

// GC (Garbage Collection)

oscillator = null;

lfo = null;

depth = null;

buttonElement.textContent = 'start';

});

rangeFrequencyElement.addEventListener('input', (event) => {

frequency = event.currentTarget.valueAsNumber;

if (oscillator && depth) {

oscillator.frequency.value = frequency;

depth.gain.value = oscillator.frequency.value * depthRate;

}

spanPrintFrequencyElement.textContent = `${(Math.trunc(frequency * 10) / 10)} Hz`;

});

rangeDepthElement.addEventListener('input', (event) => {

depthRate = event.currentTarget.valueAsNumber;

if (oscillator && depth) {

depth.gain.value = oscillator.frequency.value * depthRate;

}

spanPrintDepthElement.textContent = depthRate.toString(10);

});

rangeRateElement.addEventListener('input', (event) => {

rateValue = event.currentTarget.valueAsNumber;

if (lfo) {

lfo.frequency.value = rateValue;

}

spanPrintRateElement.textContent = Math.trunc(rateValue).toString(10);

});

LFO の波形

ここまでの解説やコードでは, LFO の波形は OscillatorNode のデフォルト値である sin 波 ('sine') を使っていました.

LFO としてはこれで十分機能しますが, 波形 (OscillatorNode の type プロパティ (OscillatorOptions))

をノコギリ波や三角波にしても LFO として機能します. また, ランダムなパラメータ変化をさせるためにホワイトノイズを使う場合もあります.

もし必要であれば, LFO の波形も選択できるようにすると, エフェクトにバリエーションが出せるかもしれません.

ディレイ・リバーブ

ディレイ・リバーブがどんなエフェクターかを簡単に表現すると, ディレイはやまびこ現象を再現するエフェクター, リバーブはコンサートホールなどの (主に,

室内の) 音の響きを再現するエフェクターとなるでしょう.

表現上はまったく別のエフェクターのように思えますが, その原理は同じです (また, ディレイのパラメータの設定しだいでは,

簡易的なリバーブを再現することも可能です). ディレイ・リバーブともに, FIR フィルタ , つまり,

加算・乗算・遅延というデジタルフィルタにおける基本処理で実装可能な点です.

ディレイ

ディレイを実装するために必要な処理は, DelayNodeの接続とフィードバックです.

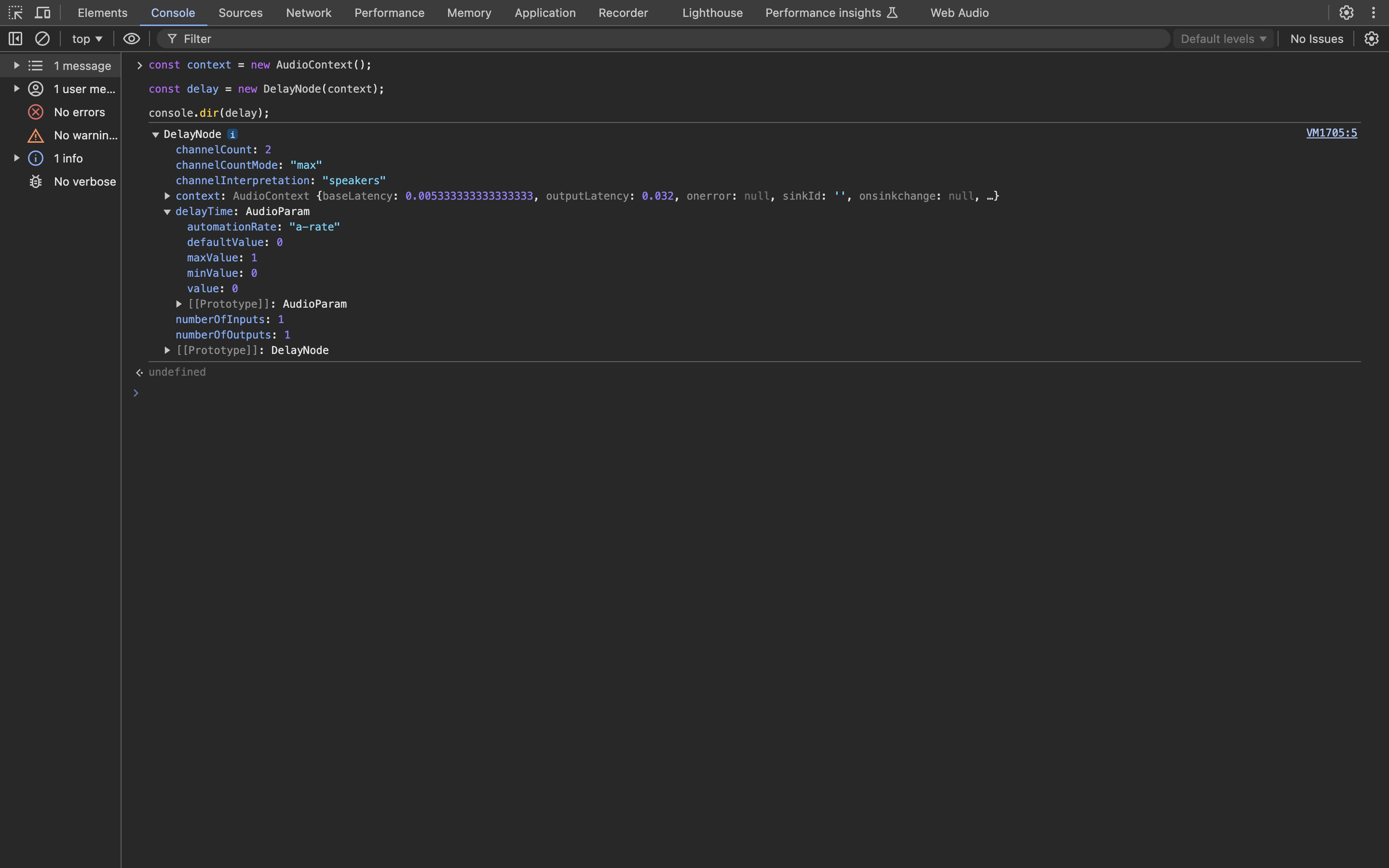

DelayNode

遅延処理を (抽象化して) 実装するために定義されているのが, DelayNodeDelayOptionsmaxDelayTime1 sec です.

const context = new AudioContext();

const delay = new DelayNode(context, { maxDelayTime: 5 }); // 5 sec

// If use `createDelay`

// const delay = context.createDelay(5); // 5 sec

DelayNode インスタンスには, AudioParam である delayTime0 sec, 最大値はインスタンス生成時に指定した値 (sec) です.

遅延した音を生成するには, サウンドの入力点となるノード (OscillatorNode など) を DelayNode に接続します.

以下のコードは, サウンド出力点である AudioDestinationNode に対して 2 つの入力ノードが接続されています. 1 つは, 原音を出力するため,

そして, もう 1 つは遅延音を出力するためです. このように, 複数のノードを入力ノードとして接続することで,

それぞれ入力された音をミックスすることが可能になります. これは, ディレイだけではなく他のエフェクターを実装する場合においても,

原音とエフェクト音をミックスする という処理は必要になります.

const context = new AudioContext();

const delay = new DelayNode(context);

// If use `createDelay`

// const delay = context.createDelay();

delay.delayTime.value = 0.5;

const oscillator = new OscillatorNode(context);

// Connect nodes for original sound

// OscillatorNode (Input) -> AudioDestinationNode (Output)

oscillator.connect(context.destination);

// Connect nodes for delay sound

// OscillatorNode (Input) -> DelayNode (Delay) -> AudioDestinationNode (Output)

oscillator.connect(delay);

delay.connect(context.destination);

oscillator.start(0);

oscillator.stop(context.currentTime + 2);

これで, ディレイが実装できました ... と言いたいところですが, このコードでは, エフェクターとしてのディレイ は実現できていません.

エフェクターとしての という意味は, 上記のコードでも遅延した音は発生します. しかしながら, やまびこ現象のように,

遅延音が少しずつ減衰しながら何度も繰り返し生成することが実装できていません.

Web Audio API の設計思想からの観点で説明すると,

DelayNode は, 指定された遅延時間で遅延音を 1 つだけ生成することだからです

そこで, エフェクターとしてのディレイを実装するには,

DelayNode の接続と次のセクションで解説するフィードバック という処理が必要になります.

フィードバック

フィードバック とは, 出力された音を入力音として利用することです. つまり, DelayNode によって出力された遅延音を,

再び入力音とすればディレイを実現することが可能です. これを, Web Audio APIで実装するには,

フィードバックのための GainNode を接続して, その入出力に同じ DelayNode を接続します. また,

フィードバックの実装は, ディレイに限らず, 様々なエフェクターで必要となります.

ちなみに, エレキギターではフィードバック奏法と呼ばれる奏法があります. この奏法は, アンプから出力された音で弦を振動させて,

それをピックアップが拾い, 再びアンプから出力させることで, 理論上, 永遠の音の伸びを奏でる奏法です.

const context = new AudioContext();

const delay = new DelayNode(context);

// If use `createDelay`

// const delay = context.createDelay();

delay.delayTime.value = 0.5;

const feedback = new GainNode(context, { gain: 0.5 });

const oscillator = new OscillatorNode(context);

// Connect nodes for original sound

// OscillatorNode (Input) -> AudioDestinationNode (Output)

oscillator.connect(context.destination);

// Connect nodes for delay sound

// OscillatorNode (Input) -> DelayNode (Delay) -> AudioDestinationNode (Output)

oscillator.connect(delay);

delay.connect(context.destination);

// Connect nodes for feedback

// (OscillatorNode (Input) ->) DelayNode (Delay) -> GainNode (Feedback) -> DelayNode (Delay) -> GainNode (Feedback) -> ...

delay.connect(feedback);

feedback.connect(delay);

oscillator.start(0);

oscillator.stop(context.currentTime + 2);上記のコードでは, 大きく 3 つの接続ができました.

原音を出力する接続

エフェクト音 (遅延音) を出力する接続

フィードバック (エフェクト音を再び入力する) のための接続

フィードバック (エフェクト音を再び入力する) の接続によって, 遅延音が少しずつ減衰しながら何度も繰り返し生成されます. 具体例として, 原音のゲインを

1, フィードバッグのゲインが 0.5 とすると, 1 つめの遅延音のゲインは, 0.5 (1 x 0.5), 2

つめの遅延音のゲインは, 0.25 (0.5 x 0.5), 3 つめの遅延音のゲインは, 0.125 (0.25 x 0.5) ...

といった繰り返しで, 遅延音が少しずつ減衰しながら生成されます. つまり, フィードバックの GainNode の

gain プロパティを適切に設定すれば, エフェクターとしてのディレイにバリエーションが出せるというこでもあります.

ただし, フィードバックの値は 1 未満にする必要があります . これは, 直感的な説明をすれば,

1 以上にすると減衰しない状態 (無限ループのような状態) になってしまうからです. 数学的・工学的な厳密性で説明すると,

絶対可積分 を満たさなくなり, (のちのセクションで解説する) FIR

フィルタが安定しないフィルタとなるからです.

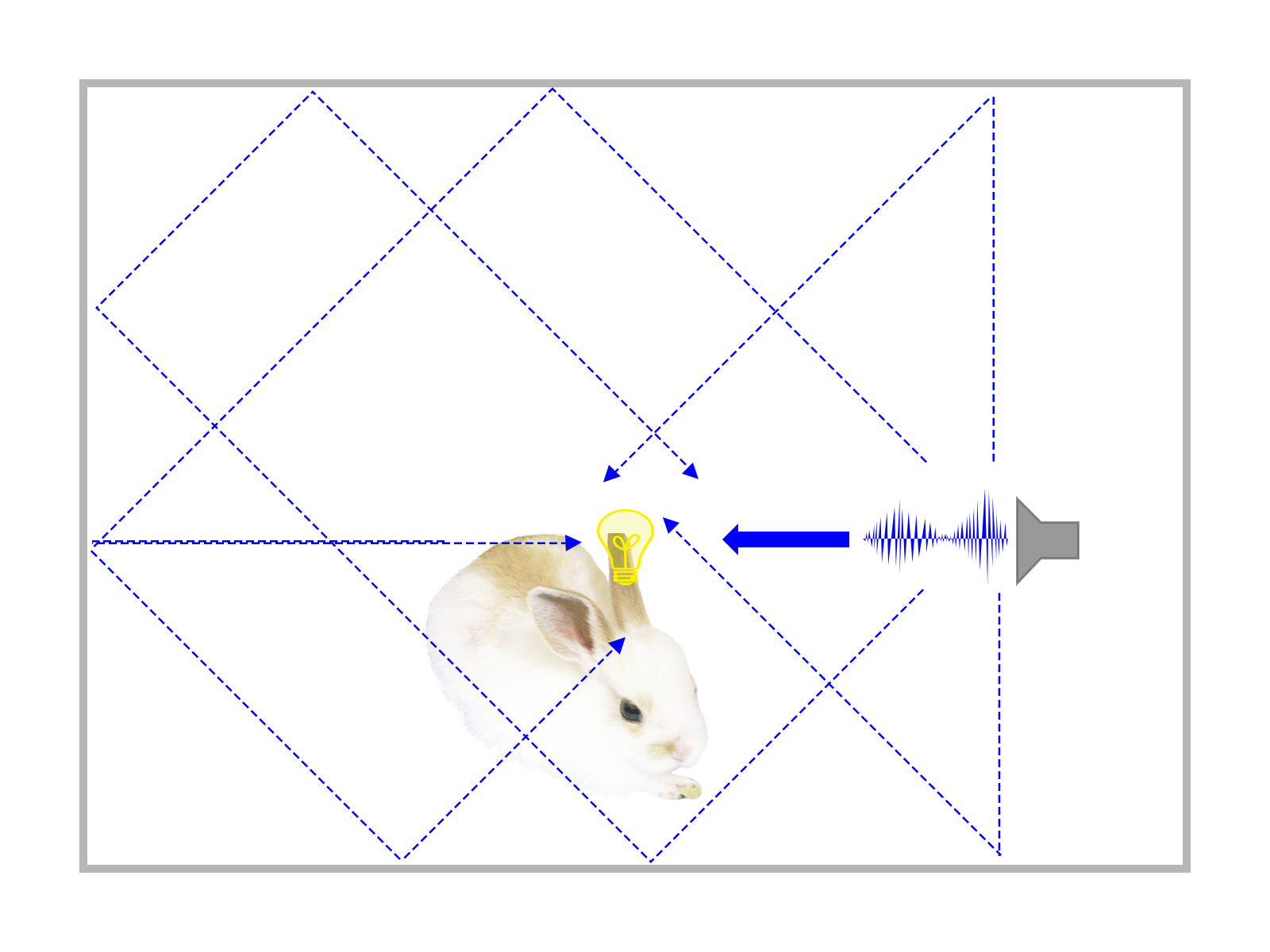

フィードバックのイメージ

start

Dry / Wet

Dry / Wet とは, 原音とエフェクト音のゲインを調整するパラメータ (または, そのような機能) のことです.

現実世界のエフェクターにおいても, Dry (原音) / Wet (エフェクト音) としてコントロール可能になっているものが多いので,

このドキュメントでもそれに従って Dry / Wet (あるいは, それらを合わせる Mix) と呼ぶことにします.

const context = new AudioContext();

const delay = new DelayNode(context, { delayTime: 0.5 });

// If use `createDelay`

// const delay = context.createDelay();

// delay.delayTime.value = 0.5;

const dry = new GainNode(context, { gain: 0.7 }); // for gain of original sound

const wet = new GainNode(context, { gain: 0.3 }); // for gain of delay sound

const feedback = new GainNode(context, { gain: 0.5 }); // for feedback

const oscillator = new OscillatorNode(context);

// Connect nodes for original sound

// OscillatorNode (Input) -> GainNode (Dry) -> AudioDestinationNode (Output)

oscillator.connect(dry);

dry.connect(context.destination);

// Connect nodes for delay sound

// OscillatorNode (Input) -> DelayNode (Delay) -> GainNode (Wet) -> AudioDestinationNode (Output)

oscillator.connect(delay);

delay.connect(wet);

wet.connect(context.destination);

// Connect nodes for feedback

// (OscillatorNode (Input) ->) DelayNode (Delay) -> GainNode (Feedback) -> DelayNode (Delay) -> GainNode (Feedback) -> ...

delay.connect(feedback);

feedback.connect(delay);

oscillator.start(0);

oscillator.stop(context.currentTime + 2);

上記のコードは, Dry / Wet のための GainNode を接続して, ディレイの実装完成コードです. Dry / Wet の制御を可能にすることで,

原音とエフェクト音のゲインを調整するだけで, ディレイにさらなるバリエーションが生まれます. さらに, ノード接続を変更することなくエフェクターのオン

/ オフを切り替えることが可能になります. 例えば, Dry を 1, Wet を 0 にすれば, エフェクターオフ (つまり, 原音のみ)

のサウンドになります.

ディレイのノード接続図

フィードバックと同様に, Dry / Web (あるいは, Mix) のパラメータ制御は, ディレイだけではなく, 他のエフェクターでも利用されるので, まずは,

ノード接続が比較的単純なディレイの実装でそれらを理解しておくとよいでしょう.

遅延音の実装とリングバッファ

ディレイはエフェクター実装における基本を理解するためにも最適なエフェクターですが, ディレイのコアとなる,

遅延音はどのようにして実装するのでしょうか ? (Web Audio API では,

DelayNode がそれを抽象化しているので気にすることはほとんどないと思いますが). 結論的には,

リングバッファ に入力された音を格納する (enqueue) ことで, 過去の入力音をリングバッファのサイズだけ蓄積する事が可能です (DelayNode

コンストラクタで指定する遅延時間の最大値は, このリングバッファのサイズを決定するためにあります). 指定した

delayTime の値が経過したら, リングバッファに格納した過去の入力音を, 原音 (現在時刻の音) と合成して出力します.

加算・乗算・遅延はデジタルフィルタを構成する基本処理なので, 遅延に関しても,

ローレイヤーでどのように実装されているかを理解しておくと応用が利くはずです. 実装言語は C++ になりますが, より詳細な解説は,

ディレイの実装例 | C++でVST作り を参考にするとよいと思います.

リバーブ

簡易的なリバーブであれば, ディレイのパラメータを適切に設定することで実装することは可能です. しかしながら, 現実世界のエフェクターのリバーブは,

ディレイと実装は異なり, シミュレートしたい音響空間のインパルス応答 (RIR : Room Impulse Response )

と呼ばれるオーディオデータを利用します. インパルス応答の詳細に関しては, 後半のセクションで解説しますので, とりあえず,

リバーブを実装してみましょう.

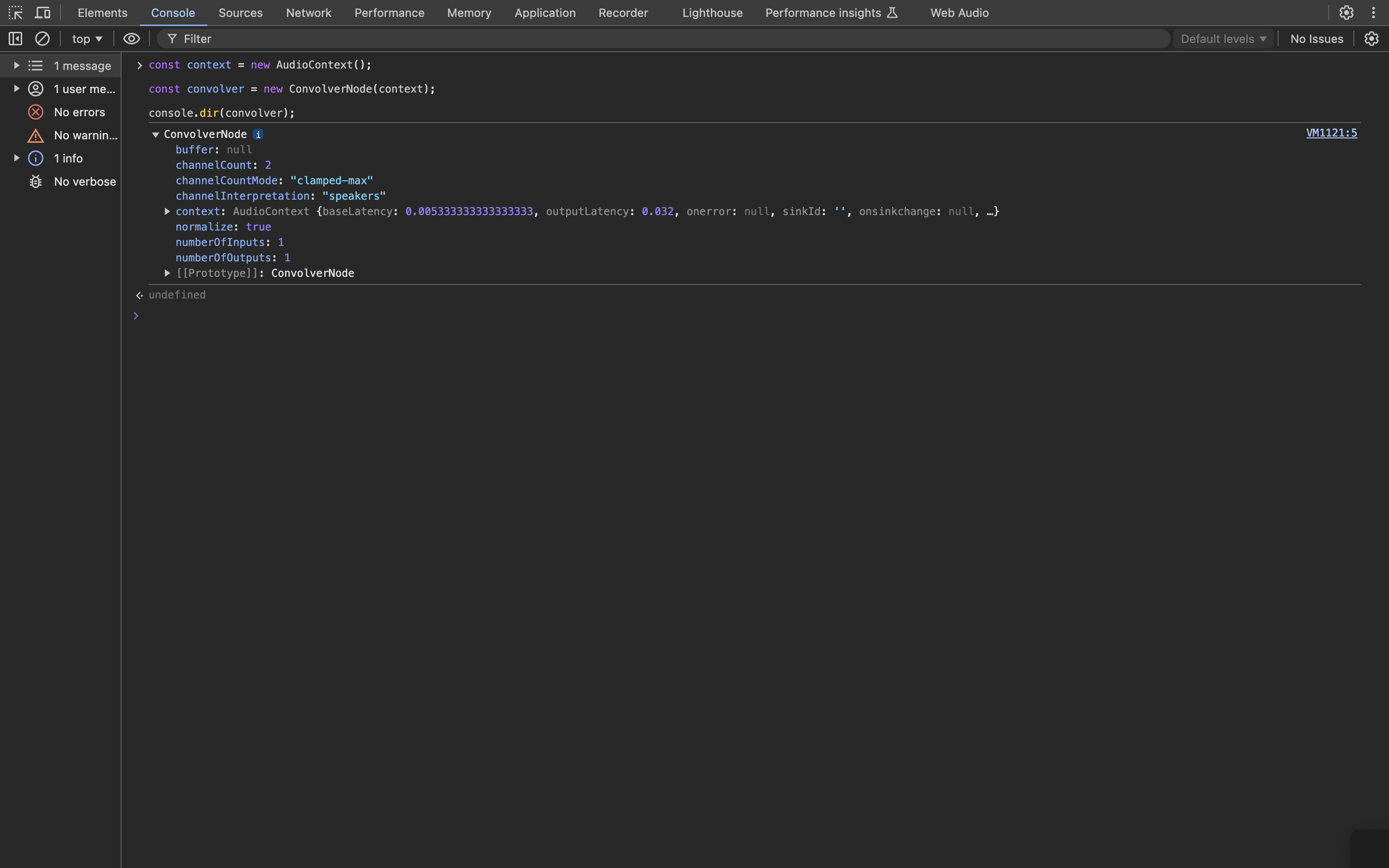

ConvolverNode

インパルス応答のオーディオデータをエフェクターとして利用するには, ConvolverNodeConvolverNode は,

コンボリューション積分 (畳み込み積分 , 合成積 ) という数学的な演算を抽象化する AudioNode です

(デジタルフィルタの視点では, FIR フィルタ を抽象化します. のちほど解説しますが, 見立ての違いであり, 本質的には, コンボリューション積分も

FIR フィルタも同じです. コンボリューション積分も FIR フィルタも次のセクション以降で解説しています).

const context = new AudioContext();

const convolver = new ConvolverNode(context);

// If use `createConvolver`

// const convolver = context.createConvolver();

ConvolverNode には, bufferbuffer プロパティに, インパルス応答

(RIR) のオーディオデータの AudioBuffer インスタンスを設定します (コンストラクタ生成であれば,

ConvolverOptionsbuffer プロパティで設定することも可能です).

AudioBuffer インスタンスの生成は, ワンショットオーディオ と同じです.

const context = new AudioContext();

fetch('./assets/rirs/rir.mp3')

.then((response) => {

return response.arrayBuffer();

})

.then((arrayBuffer) => {

const successCallback = (audioBuffer) => {

const convolver = new ConvolverNode(context);

// If use `ConvolverOptions`

// const convolver = new ConvolverNode(context, { buffer: audioBuffer });

// If use `createConvolver`

// const convolver = context.createConvolver();

convolver.buffer = audioBuffer;

};

const errorCallback = (error) => {

// error handling

};

context.decodeAudioData(arrayBuffer, successCallback, errorCallback);

})

.catch((error) => {

// error handling

});

サウンドの入力点となるノード (OscillatorNode など) を ConvolverNode に接続して, ConvolverNode を

AudioDestinationNode に接続します.

const context = new AudioContext();

fetch('./assets/rirs/rir.mp3')

.then((response) => {

return response.arrayBuffer();

})

.then((arrayBuffer) => {

const successCallback = (audioBuffer) => {

const convolver = new ConvolverNode(context);

// If use `ConvolverOptions`

// const convolver = new ConvolverNode(context, { buffer: audioBuffer });

// If use `createConvolver`

// const convolver = context.createConvolver();

convolver.buffer = audioBuffer;

const dry = new GainNode(context, { gain: 0.6 }); // for gain of original sound

const wet = new GainNode(context, { gain: 0.4 }); // for gain of reverb sound

const oscillator = new OscillatorNode(context);

// Connect nodes for original sound

// OscillatorNode (Input) -> GainNode (Dry) -> AudioDestinationNode (Output)

oscillator.connect(dry);

dry.connect(context.destination);

// Connect nodes for reverb sound

// OscillatorNode (Input) -> ConvolverNode (Reverb) -> GainNode (Wet) -> AudioDestinationNode (Output)

oscillator.connect(convolver);

convolver.connect(wet);

wet.connect(context.destination);

oscillator.start(0);

oscillator.stop(context.currentTime + 5);

};

const errorCallback = (error) => {

// error handling

};

context.decodeAudioData(arrayBuffer, successCallback, errorCallback);

})

.catch((error) => {

// error handling

});

ディレイの場合と同じように, 原音とエフェクト音の接続, そして, Dry / Wet の GainNode も接続しています.

遅延音の生成処理と遅延音に対する演算処理は, ConvolverNode が抽象化しているので, フィードバックのための接続は不要です.

リバーブのノード接続図

以上で, リバーブが完成しました. ところで, リバーブを利用するためには, インパルス応答 (RIR) のオーディオファイルが必要です.

楽曲やワンショットオーディオファイルはあっても, インパルス応答のオーディオデータをもっている人は少ないと思います.

機材をもっていれば実際に測定するのも可能ですが, そこまでするのはちょっとめんどうです. となると, Web

上で公開されているファイルを利用することになるのですが, 利用条件や著作権の関係から無償で自由に利用できるのは意外とありません. とりあえず, 1

つ紹介するのは,

Concert Hall Impulse Responses - Pori, Finland

です. readme.txt の 5.

Copyright のセクションに, 「The data are provided free for noncommercial purposes, provided the authors are cited when the data are used in any research application. 」と記載されているので, 非商用利用であれば, 自身が開発されている Web アプリケーションに利用しても問題なさそうです.

インパルス応答

インパルス応答を理解するには, まずは, インパルス音 について理解する必要があります. インパルス音とは,

ごく短時間において瞬間的に発生する音です. 具体的には, ピストルの音や風船が破裂するときの音がインパルス音と言えるでしょう.

インパルス音のイメージは以下のグラフのようになります. このような物理現象を数式でモデリングするための最適な関数が, デルタ関数 です.

インパルス音 (デルタ関数) のグラフ表現

以下は, デルタ関数の定義です. デルタ関数は, $t = t_{r}$ において, 横幅が

$\lim_{\mathrm{w}\to 0}$ , 高さが $\lim_{\mathrm{h}\to \infty}$ となる関数

(数学での関数をより一般化した, 超関数 に分類されます) なので, 無限の区間において積分すると, その値 (つまり, 面積) が

1 となります.

$

\begin{flalign}

&\delta\left(t - t_{r}\right)dt =

\begin{cases}

\infty & (\mathrm{if} \quad t = t_{r}) \\

0 & (\mathrm{if} \quad t \neq t_{r})

\end{cases}

\end{flalign}

$

$

\begin{flalign}

&\int_{-\infty}^{\infty}\delta\left(t - t_{r}\right)dt = 1 \\

\end{flalign}

$

インパルス音を室内で発生させると, 音が天井や壁などに反射して, 音の響き, すなわち, 残響 が発生します. カラオケが好きなかたであれば,

エコー のような効果と考えてもよいでしょう.

直接音以外にも反射音 (初期反射音) や何度も反射して聴こえる残響音 (後期残響音) が室内では発生します

インパルス応答のイメージ

start

これが, インパルス応答 です. つまり, インパルス音を音響空間に対する入力としたときの出力 (応答) ということです. そして, その出力が音響空間における, 残響特性を表すことになるので , インパルス応答を利用することによって,

コンサートホールなどの音響空間の音の響きをシミュレートするエフェクターであるリバーブが実現できるというわけです. ちなみに,

室内でのインパルス応答をシミュレートする事が多いので, RIR (Room Impulse Response) と表現されることもあります.

実際の RIR の波形

start

また, この残響が, ディレイにおけるフィードバックと類似した音響効果を発生させることになります

(フィードバックのアニメーションとインパルス応答のアニメーションが類似していることに気付いたかもしれません).

イメージでインパルス応答は理解できるかと思いますが, それをコンピュータで実現する場合, 数式でモデリングできる必要があります.

ConvolverNode の命名 (Convolve : 畳み込む) が表すように, その演算処理がコンボリューション積分 (畳み込み積分 ,

合成積 ) です. 言い換えると, ConvolverNode は, コンボリューション積分を抽象化した AudioNode です.

コンボリューション積分

コンボリューション積分 とは, 以下の数式で定義されるように, 信号の遅延と乗算, それらの無限区間の積分によって構成されています.

$x\left(t\right)$ は入力信号, $y\left(t\right)$ は出力信号,

$h\left(t_{r}\right)$ は, インパルス応答の信号 (ConvolverNode の

buffer プロパティに設定する, AudioBuffer のオーディオデータと考えてもよいでしょう) です.

$

\begin{flalign}

&y\left(t\right) = \int_{0}^{\infty}x\left(t - t_{r}\right)h\left(t_{r}\right)dt

\end{flalign}

$

コンピュータでは, 連続信号をあつかうことはできないので, サンプリングされた離散信号の遅延と乗算, それらの加算となります. また,

無限の加算はできないので, 有界な値 (サンプル数) $N$ となります.

$

\begin{flalign}

&y\left(n\right) = \sum_{m = 0}^{N}x\left(n - m\right)h\left(m\right)

\end{flalign}

$

具体的に理解するために, $N = 5$ として, 展開してみます.

$

\begin{flalign}

&y\left(n\right) = x\left(n\right)h\left(0\right) + x\left(n - 1\right)h\left(1\right) + x\left(n - 2\right)h\left(2\right) + x\left(n - 3\right)h\left(3\right) + x\left(n - 4\right)h\left(4\right) + x\left(n - 5\right)h\left(5\right)

\end{flalign}

$

理解しやすいように, 入力信号 $x\left(n\right)$ は, 振幅が 1 のパルス列とします. また,

出力信号の実際の値を算出するために, インパルス応答の信号は, 以下の値とします.

$

\begin{flalign}

&h\left(0\right) = 1.0 \\

&h\left(1\right) = 0.75 \\

&h\left(2\right) = 0.5 \\

&h\left(3\right) = 0.25 \\

&h\left(4\right) = 0.125 \\

&h\left(5\right) = 0.0625 \\

\end{flalign}

$

これらの信号のコンボリューション積分をイラストにすると, 以下のようなグラフになります.

コンボリューション積分

上部が入力信号のパルス列 ($x\left(n\right)$ ), 中央がインパルス応答 ($h\left(m\right)$ ), 下部がコンボリューション積分結果の出力信号 ($y\left(n\right)$ ) となります.

出力信号の振幅のみスケールが異なることに注意してください. ここで, $n = 3$ に相当する時刻までの値を,

先ほどの展開したコンボリューション積分に適用して実際の値を算出すると,

$

\begin{flalign}

&y\left(0\right) = x\left(0\right)h\left(0\right) + x\left(-1\right)h\left(1\right) + x\left(-2\right)h\left(2\right) + x\left(-3\right)h\left(3\right) + x\left(-4\right)h\left(4\right) + x\left(-5\right)h\left(5\right) \\

&y\left(1\right) = x\left(1\right)h\left(0\right) + x\left(0\right)h\left(1\right) + x\left(-1\right)h\left(2\right) + x\left(-2\right)h\left(3\right) + x\left(-3\right)h\left(4\right) + x\left(-4\right)h\left(5\right) \\

&y\left(2\right) = x\left(2\right)h\left(0\right) + x\left(1\right)h\left(1\right) + x\left(0\right)h\left(2\right) + x\left(-1\right)h\left(3\right) + x\left(-2\right)h\left(4\right) + x\left(-3\right)h\left(5\right) \\

&y\left(3\right) = x\left(3\right)h\left(0\right) + x\left(2\right)h\left(1\right) + x\left(1\right)h\left(2\right) + x\left(0\right)h\left(3\right) + x\left(-1\right)h\left(4\right) + x\left(-2\right)h\left(5\right) \\

\end{flalign}

$

負数に相当する時刻は, 振幅が 0 とみなせるので, $n \geq 0$ の項のみ記述すると,

$

\begin{flalign}

&y\left(0\right) = x\left(0\right)h\left(0\right) \\

&y\left(1\right) = x\left(1\right)h\left(0\right) + x\left(0\right)h\left(1\right) \\

&y\left(2\right) = x\left(2\right)h\left(0\right) + x\left(1\right)h\left(1\right) + x\left(0\right)h\left(2\right) \\

&y\left(3\right) = x\left(3\right)h\left(0\right) + x\left(2\right)h\left(1\right) + x\left(1\right)h\left(2\right) + x\left(0\right)h\left(3\right) \\

\end{flalign}

$

また, 入力信号は, 振幅 1 のパルス列なので, $x\left(n\right) = 1$ となるので,

$

\begin{flalign}

&y\left(0\right) = h\left(0\right) \\

&y\left(1\right) = h\left(0\right) + h\left(1\right) \\

&y\left(2\right) = h\left(0\right) + h\left(1\right) + h\left(2\right) \\

&y\left(3\right) = h\left(0\right) + h\left(1\right) + h\left(2\right) + h\left(3\right) \\

\end{flalign}

$

最後に, $h\left(m\right)$ の実際の値を適用すれば, 出力信号 $y\left(n\right)$ の

$n = 3$ までの値が算出できます.

$

\begin{flalign}

&y\left(0\right) = 1.0 \\

&y\left(1\right) = 1.0 + 0.75 = 1.75 \\

&y\left(2\right) = 1.0 + 0.75 + 0.5 = 2.25 \\

&y\left(3\right) = 1.0 + 0.75 + 0.5 + 0.25 = 2.5 \\

\end{flalign}

$

目視レベルではありますが, グラフで表示されている出力信号と (大きく) 値の相違がないことが確認できます. 計算結果を抽象化すると,

コンボリューション積分で生成された出力信号は, 現在の時刻の信号だけではなく, 過去の信号の影響も受ける ということですということです (逆に,

それを, 厳密に数式で定義したのがコンボリューション積分と言えます).

$N = 5$ , $n = 3$ の場合の, コンボリューション積分のイメージstart

入力信号やインパルス応答が, 現実世界のようにより複雑になると, 計算自体も複雑になりますが, コンボリューション積分がどうのような演算か, そして,

ConvolverNode が抽象化している演算

もっとも, 数学・物理的に理解しようとすると少し難しく感じるかもしれませんが, プログラミング言語で実装すれば, 2

重ループと積和演算で構成される単純な処理です.

// コンボリューション積分のコード片

const x = new Float32Array(2400);

const h = new Float32Array(1200);

const y = new Float32Array(2400);

// 入力信号

for (let n = 0; n < x.length; n++) {

x[n] = Math.sin((2 * Math.PI * n * 2) / 1200);

}

// インパルス応答

for (let m = 0; m < h.length; m++) {

h[m] = 0.5 * Math.exp(-m);

}

// 出力信号

for (let n = 0; n < x.length; n++) {

for (let m = 0; m < h.length; m++) {

if ((n - m) >= 0) {

y[n] += (x[n - m] * h[m]);

}

}

}

巡回畳み込み

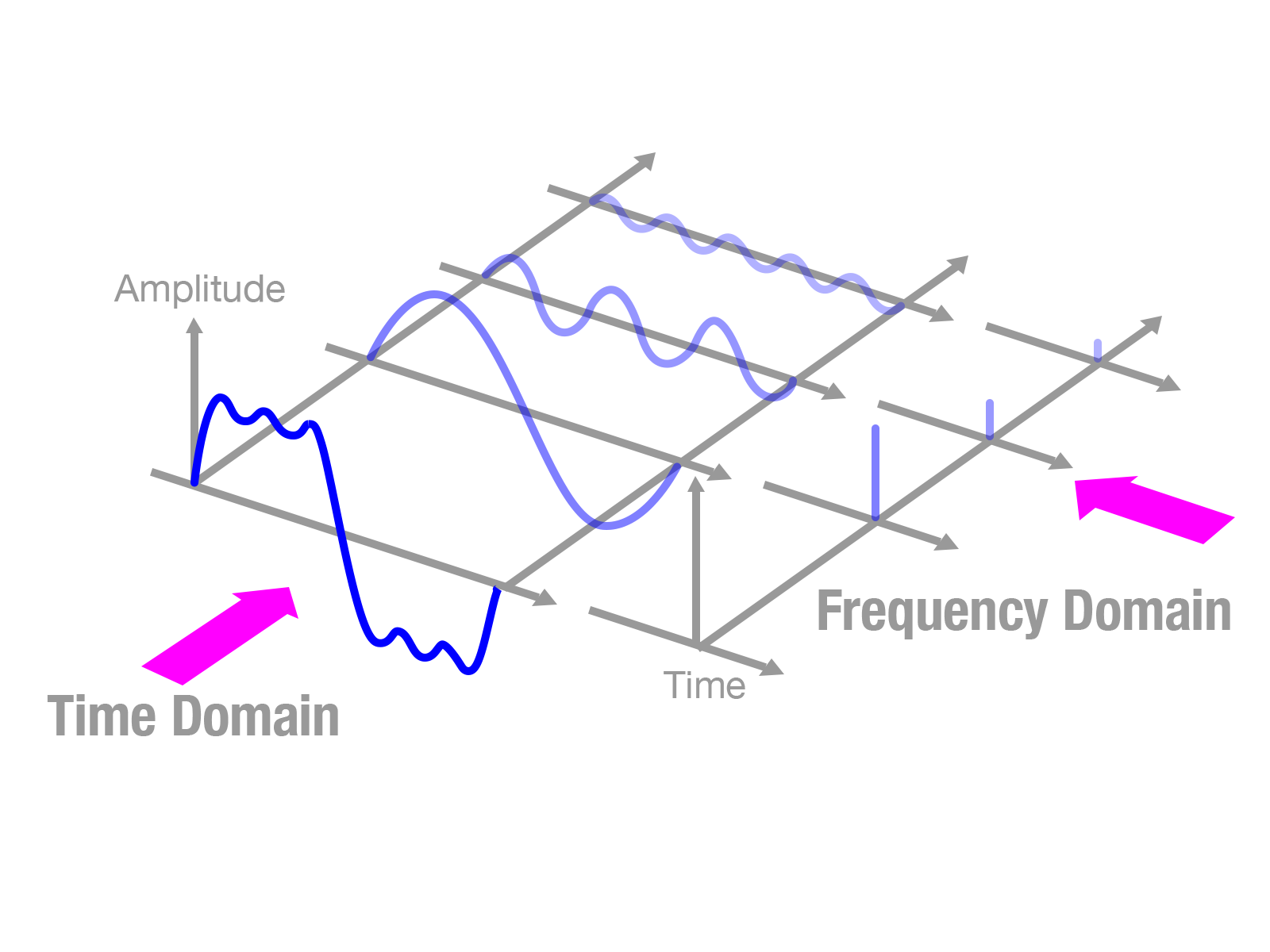

コンボリューション積分は, 周波数領域においては乗算 となります. したがって, 時間領域の入力信号

$x\left(n\right)$ を (離散) フーリエ変換した信号を $X\left(k\right)$ ,

インパルス応答を (離散) フーリエ変換した信号を $H\left(k\right)$ , 出力信号

$y\left(n\right)$ を (離散) フーリエ変換した信号を

$Y\left(k\right)$ と定義すると, コンボリューション積分は以下のように定義することもできます,

$F$ はフーリエ変換 (離散フーリエ変換), $F^{-1}$ は逆フーリエ変換

(逆離散フーリエ変換) です.

$

\begin{flalign}

&y\left(n\right) = \sum_{m = 0}^{N}x\left(n - m\right)h\left(m\right) = F^{-1}\left[Y\left(k\right)\right] = F^{-1}\left[X\left(k\right)H\left(k\right)\right]

\end{flalign}

$

この性質を利用して, 時間領域ではコンボリューション積分になるオーディオ信号処理を, 周波数領域に変換して, 乗算のみで信号処理を適用して,

時間領域に変換する巡回畳み込み という処理 (ある種のテクニック的な処理です) があります.

インパルス応答も数学的には, デルタ関数のフーリエ変換と周波数領域で定義される伝達関数 の乗算の逆フーリエ変換で定義することもできます (以下,

簡単にですが, 導出を記載しておきます).

$

\begin{flalign}

&h\left(n\right) = \sum_{m = 0}^{\infty}\delta\left(n - m\right)h\left(m\right) = F^{-1}\left[F\left[\delta\left(n\right)\right]H\left(k\right)\right]

\end{flalign}

$

ここで, デルタ関数のフーリエ変換を導出すると (導出の理解が難しければ, とりあえず

$F\left[\delta\left(t\right)\right] = 1$ と覚えてしまっていいでしょう. 他に覚えやすいフーリエ変換関係だと,

矩形関数とシンク関数 ($\frac{\sin\pi x}{\pi x}$ ) は, 互いにフーリエ変換の関係にあります),

$

\begin{flalign}

&F\left[\delta\left(t\right)\right] = \int_{-\infty}^{\infty}\delta\left(t\right)e^{-j2 \pi ft}dt

\end{flalign}

$

デルタ関数の定義より, 上記のフーリエ変換において, $t = 0$ 以外の積分区間では

$\delta\left(t\right) = 0$ となるので,

$

\begin{flalign}

&F\left[\delta\left(t\right)\right] = \int_{-\infty}^{\infty}\delta\left(0\right)e^{-j2 \pi f \cdot 0}dt = \int_{-\infty}^{\infty}\delta\left(0\right)dt \cdot e^{0} = 1 \cdot 1 = 1

\end{flalign}

$

(数学的な厳密性は欠いてしまいますが, 同じように離散信号にも適用すると) デルタ関数のフーリエ変換は 1 です. つまり,

$F\left[\delta\left(n\right)\right] = 1$ なので,

$

\begin{flalign}

&h\left(n\right) = \sum_{m = 0}^{\infty}\delta\left(n - m\right)h\left(m\right) = F^{-1}\left[F\left[\delta\left(n\right)\right]H\left(k\right)\right] = F^{-1}\left[H\left(k\right)\right]

\end{flalign}

$

Web Audio API は (他のオーディオ API と比較すると) 抽象度が高いので, 巡回畳み込みまで駆使するケースはほとんどないかもしれませんが,

一応知っておくと実装のヒントになることがあるかもしれません.

FIR フィルタ

デジタルフィルタを数学的な厳密性まで含めて解説すると, それだけで 1 冊の書籍になるぐらいの解説になるので, FIR

フィルタをディレイ・リバーブの観点で解説します.

FIR フィルタ (Finite Impulse Response filter ) は, 以下の数式で定義されるデジタルフィルタです.

$

\begin{flalign}

&y\left(n\right) = \sum_{m = 0}^{N}x\left(n - m\right)h\left(m\right)

\end{flalign}

$

数式的には, コンボリューション積分と同じです. すなわち, 見立ての違い でしかありません. 数学的にはコンボリューション積分, 工学的には FIR

フィルタと表現しています. 言い換えると, コンボリューション積分を実装に落とし込んだのが FIR フィルタということです.

具体的に, $N = 3$ (乗算器の数 $N + 1$ )

の加算器・乗算器・遅延器の要素を利用してブロック図として表現します (遅延器の $z^{-1}$ の表記は

$z$ 変換

FIR フィルタ

FIR フィルタの図から, 逆に, コンボリューション積分の数式を導出することが可能なこともわかります.

乗算器の数 (遅延器の数もそれに比例) と係数は, ディレイは制御可能なパラメータで決定できますが, リバーブは室内の特性によって決定されます. すなわち,

乗算器の数と係数の算出がディレイとリバーブの実装に違いに表れます .

ディレイは遅延時間とフィードバックよって乗算器の数と係数を決定する のに対して,

リバーブはインパルス応答 (RIR) のオーディオデータから乗算器の数と係数が決定されます .

Schroeder Reverberator (シュレーダーリバーブ)

コムフィルタ (遅延音を生成) と All-Pass Filter (位相変化によって, 遅延音の間を補間して残響音の密度を高める) を駆使して, 人工的にリバーブ

(人工インパルス応答) を生成する実装が知られています. 実装言語は Python になりますが,

シュレーダーリバーブ(人工残響エフェクタ)のPython実装と試聴デモ などが参考になります.

コーラス・フランジャー

コーラス は, 音に揺らぎを与えるエフェクターです. 合唱では, どんなに歌唱力の高い人が集まって歌っても多少なりともピッチのずれは生じてしまいます.

しかし, この微妙なずれが合唱らしさを生み出している要因でもあります. コーラスでは, この微妙なピッチのずれをオーディオ信号処理で再現します.

フランジャー は, ジェット機のエンジン音のように, 音に強烈なうねりを与えるエフェクターです.

このように, コーラスとフランジャーは, エフェクターとしてはまったく異なるように感じますし, 現実世界のエフェクターでも,

コーラスとフランジャーはそれぞれ別に存在していますが, その原理は同じです. ディレイタイム (遅延時間) を周期的に変化させる ことによって,

FM 変調 を発生させている点です. 原理が同じであるにも関わらず, 別のエフェクターとして感じるのは,

パラメータの設定値やフィードバックの有無が影響しています (また, 音楽的に目的が異なるので, それぞれ,

コーラス・フランジャーとして別になっていると思います).

コーラス・フランジャーはディレイが基本となっているので, ディレイの実装がよくわからないという場合は, (前のセクション解説しているので)

ディレイの実装を理解してから, このセクションを進めてください.

コーラス

コーラスは, ディレイタイムを周期的に変化させたエフェクト音 を原音とミックスすることにより実装できます.

ディレイタイムを周期的に変化させることが実装のポイントになりますが, ここで LFO を利用することで, ディレイタイムを周期的に変化させることができます.

つまり, Web Audio API においては, LFO の接続先を DelayNode の AudioParam である

delayTime プロパティに接続すれば実装完了です.

まず, 原音の出力の接続と, エフェクト音の出力の接続 (DelayNode の接続) のみを実装します.

const context = new AudioContext();

const delay = new DelayNode(context, { delayTime: 0.02 });

const oscillator = new OscillatorNode(context);

// Connect nodes for original sound

// OscillatorNode (Input) -> AudioDestinationNode (Output)

oscillator.connect(context.destination);

// Connect nodes for delay sound

// OscillatorNode (Input) -> DelayNode (Delay) -> AudioDestinationNode (Output)

oscillator.connect(delay);

delay.connect(context.destination);

oscillator.start(0);

oscillator.stop(context.currentTime + 2);

そして, LFO の実装で解説したように, LFO のための OscillatorNode インスタンスと

GainNode インスタンス (Depth パラメータ) を生成して, DelayNode の delayTime プロパティ

const context = new AudioContext();

const baseDelayTime = 0.020;

const depthValue = 0.005;

const rateValue = 1;

const delay = new DelayNode(context, { delayTime: baseDelayTime });

const oscillator = new OscillatorNode(context);

const lfo = new OscillatorNode(context, { frequency: rateValue });

const depth = new GainNode(context, { gain: depthValue });

// Connect nodes for original sound

// OscillatorNode (Input) -> AudioDestinationNode (Output)

oscillator.connect(context.destination);

// Connect nodes for delay sound

// OscillatorNode (Input) -> DelayNode (Delay) -> AudioDestinationNode (Output)

oscillator.connect(delay);

delay.connect(context.destination);

// Connect nodes for LFO that changes delay time periodically

// OscillatorNode (LFO) -> GainNode (Depth) -> delayTime (AudioParam)

lfo.connect(depth);

depth.connect(delay.delayTime);

// Start oscillator and LFO

oscillator.start(0);

lfo.start(0);

// Stop oscillator and LFO

oscillator.stop(context.currentTime + 5);

lfo.stop(context.currentTime + 5);

ディレイのノード接続からフィードバックを除いて, LFO を DelayNode の delayTime プロパティ (AudioParam)

に接続したノード接続と同じです. パラメータに関しては, コーラスの場合, 基準となるディレイタイムを 20 - 30 msec にして,

± 5 ~ 10 msec, Rate はゆっくりと 1 Hz ぐらいがよいでしょう. (もっとも, 実際のプロダクトでは,

ある程度自由度高く設定できるように, 汎用的な LFO になるように実装することになるでしょう).

コーラスの原理的な実装としてはこれで完了ですが, エフェクターとしてはまだコーラスっぽくありません.

原音とエフェクト音が同じゲインで合成されているので, 原音とエフェクト音が別々に出力されているように聴こえると思います.

原音が少し揺れているぐらいにエフェクト音を合成するとコーラスらしくなるので, Dry / Wet のための GainNode を接続して,

原音とエフェクト音のゲインを調整します.

const context = new AudioContext();

const baseDelayTime = 0.020;

const depthValue = 0.005;

const rateValue = 1;

const delay = new DelayNode(context, { delayTime: baseDelayTime });

const oscillator = new OscillatorNode(context);

const lfo = new OscillatorNode(context, { frequency: rateValue });

const depth = new GainNode(context, { gain: depthValue });

const dry = new GainNode(context, { gain: 0.7 }); // for gain of original sound

const wet = new GainNode(context, { gain: 0.3 }); // for gain of chorus sound

// Connect nodes for original sound

// OscillatorNode (Input) -> GainNode (Dry) -> AudioDestinationNode (Output)

oscillator.connect(dry);

dry.connect(context.destination);

// Connect nodes for delay sound

// OscillatorNode (Input) -> DelayNode (Delay) -> GainNode (Wet) -> AudioDestinationNode (Output)

oscillator.connect(delay);

delay.connect(wet);

wet.connect(context.destination);

// Connect nodes for LFO that changes delay time periodically

// OscillatorNode (LFO) -> GainNode (Depth) -> delayTime (AudioParam)

lfo.connect(depth);

depth.connect(delay.delayTime);

// Start oscillator and LFO

oscillator.start(0);

lfo.start(0);

// Stop oscillator and LFO

oscillator.stop(context.currentTime + 5);

lfo.stop(context.currentTime + 5);

コーラスのノード接続図

以上で, コーラスの実装は完了です. ハードコーディングしているパラメータが多いので, ある程度実際のアプリケーションを想定して, UI

からパラメータ設定を可能にすると以下のようなコードとなるでしょう (Dry / Wet は同時に設定する Mix としています).

<button type="button">start</button>

<label for="range-chorus-delay-time">Delay time</label>

<input type="range" id="range-chorus-delay-time" value="0" min="0" max="50" step="1" />

<span id="print-chorus-delay-time-value">0 msec</span>

<label for="range-chorus-depth">Depth</label>

<input type="range" id="range-chorus-depth" value="0" min="0" max="1" step="0.05" />

<span id="print-chorus-depth-value">0</span>

<label for="range-chorus-rate">Rate</label>

<input type="range" id="range-chorus-rate" value="0" min="0" max="1" step="0.05" />

<span id="print-chorus-rate-value">0</span>

<label for="range-chorus-mix">Mix</label>

<input type="range" id="range-chorus-mix" value="0" min="0" max="1" step="0.05" />

<span id="print-chorus-mix-value">0</span>const context = new AudioContext();

let oscillator = null;

let lfo = null;

let depthRate = 0;

let rateValue = 0;

let mixValue = 0;

const delay = new DelayNode(context);

const depth = new GainNode(context, { gain: delay.delayTime.value * depthRate });

const dry = new GainNode(context, { gain: 1 - mixValue });

const wet = new GainNode(context, { gain: mixValue });

const buttonElement = document.querySelector('button[type="button"]');

const rangeDelayTimeElement = document.getElementById('range-chorus-delay-time');

const rangeDepthElement = document.getElementById('range-chorus-depth');

const rangeRateElement = document.getElementById('range-chorus-rate');

const rangeMixElement = document.getElementById('range-chorus-mix');

const spanPrintDelayTimeElement = document.getElementById('print-chorus-delay-time-value');

const spanPrintDepthElement = document.getElementById('print-chorus-depth-value');

const spanPrintRateElement = document.getElementById('print-chorus-rate-value');

const spanPrintMixElement = document.getElementById('print-chorus-mix-value');

buttonElement.addEventListener('mousedown', (event) => {

if ((oscillator !== null) || (lfo !== null)) {

return;

}

oscillator = new OscillatorNode(context);

lfo = new OscillatorNode(context, { frequency: rateValue });

// Connect nodes for original sound

// OscillatorNode (Input) -> GainNode (Dry) -> AudioDestinationNode (Output)

oscillator.connect(dry);

dry.connect(context.destination);

// Connect nodes for delay sound

// OscillatorNode (Input) -> DelayNode (Delay) -> GainNode (Wet) -> AudioDestinationNode (Output)

oscillator.connect(delay);

delay.connect(wet);

wet.connect(context.destination);

// Connect nodes for LFO that changes delay time periodically

// OscillatorNode (LFO) -> GainNode (Depth) -> delayTime (AudioParam)

lfo.connect(depth);

depth.connect(delay.delayTime);

// Start oscillator and LFO immediately

oscillator.start(0);

lfo.start(0);

buttonElement.textContent = 'stop';

});

buttonElement.addEventListener('mouseup', (event) => {

if ((oscillator === null) || (lfo === null)) {

return;

}

// Stop immediately

oscillator.stop(0);

lfo.stop(0);

// GC (Garbage Collection)

oscillator = null;

lfo = null;

buttonElement.textContent = 'start';

});

rangeDelayTimeElement.addEventListener('input', (event) => {

delay.delayTime.value = event.currentTarget.valueAsNumber * 0.001;

depth.gain.value = delay.delayTime.value * depthRate;

spanPrintDelayTimeElement.textContent = `${Math.trunc(delay.delayTime.value * 1000)} msec`;

});

rangeDepthElement.addEventListener('input', (event) => {

depthRate = event.currentTarget.valueAsNumber;

depth.gain.value = delay.delayTime.value * depthRate;

spanPrintDepthElement.textContent = depthRate.toString(10);

});

rangeRateElement.addEventListener('input', (event) => {

rateValue = event.currentTarget.valueAsNumber;

if (lfo) {

lfo.frequency.value = rateValue;

}

spanPrintRateElement.textContent = rateValue.toString(10);

});

rangeMixElement.addEventListener('input', (event) => {

mixValue = event.currentTarget.valueAsNumber;

dry.gain.value = 1 - mixValue;

wet.gain.value = mixValue;

spanPrintMixElement.textContent = mixValue.toString(10);

});

フランジャー

フランジャー は, コーラスの実装にエフェクト音のフィードバックの接続を追加するだけです (ディレイの実装に LFO を追加して,

ディレイタイムを周期的に変化させるとも言えます). つまり, コーラスの実装をより汎用的にした実装となります. パラメータしだいで, フランジャーになり,

コーラスにもなります. 原理的には, 同じなのでこのあたりの区別は, 音楽的な感覚による違いでしかありません.

フランジャーのノード接続図

<button type="button">start</button>

<label for="range-flanger-delay-time">Delay time</label>

<input type="range" id="range-flanger-delay-time" value="0" min="0" max="50" step="1" />

<span id="print-flanger-delay-time-value">0 msec</span>

<label for="range-flanger-depth">Depth</label>

<input type="range" id="range-flanger-depth" value="0" min="0" max="1" step="0.05" />

<span id="print-flanger-depth-value">0</span>

<label for="range-flanger-rate">Rate</label>

<input type="range" id="range-flanger-rate" value="0" min="0" max="10" step="0.5" />

<span id="print-flanger-rate-value">0</span>

<label for="range-flanger-mix">Mix</label>

<input type="range" id="range-flanger-mix" value="0" min="0" max="1" step="0.05" />

<span id="print-flanger-mix-value">0</span>

<label for="range-flanger-feedback">Mix</label>

<input type="range" id="range-flanger-feedback" value="0" min="0" max="0.9" step="0.05" />

<span id="print-flanger-feedback-value">0</span>const context = new AudioContext();

let oscillator = null;

let lfo = null;

let depthRate = 0;

let rateValue = 0;

let mixValue = 0;

const delay = new DelayNode(context);

const depth = new GainNode(context, { gain: delay.delayTime.value * depthRate });

const dry = new GainNode(context, { gain: 1 - mixValue });

const wet = new GainNode(context, { gain: mixValue });

const feedback = new GainNode(context, { gain: 0 });

const buttonElement = document.querySelector('button[type="button"]');

const rangeDelayTimeElement = document.getElementById('range-flanger-delay-time');

const rangeDepthElement = document.getElementById('range-flanger-depth');

const rangeRateElement = document.getElementById('range-flanger-rate');

const rangeMixElement = document.getElementById('range-flanger-mix');

const rangeFeedbackElement = document.getElementById('range-flanger-feedback');

const spanPrintDelayTimeElement = document.getElementById('print-flanger-delay-time-value');

const spanPrintDepthElement = document.getElementById('print-flanger-depth-value');

const spanPrintRateElement = document.getElementById('print-flanger-rate-value');

const spanPrintMixElement = document.getElementById('print-flanger-mix-value');

const spanPrintFeedbackElement = document.getElementById('print-flanger-feedback-value');

buttonElement.addEventListener('mousedown', (event) => {

if ((oscillator !== null) || (lfo !== null)) {

return;

}

oscillator = new OscillatorNode(context);

lfo = new OscillatorNode(context, { frequency: rateValue });

// Connect nodes for original sound

// OscillatorNode (Input) -> GainNode (Dry) -> AudioDestinationNode (Output)

oscillator.connect(dry);

dry.connect(context.destination);

// Connect nodes for delay sound

// OscillatorNode (Input) -> DelayNode (Delay) -> GainNode (Wet) -> AudioDestinationNode (Output)

oscillator.connect(delay);

delay.connect(wet);

wet.connect(context.destination);

// Connect nodes for feedback

// (OscillatorNode (Input) ->) DelayNode (Delay) -> GainNode (Feedback) -> DelayNode (Delay) -> GainNode (Feedback) -> ...

delay.connect(feedback);

feedback.connect(delay);

// Connect nodes for LFO that changes delay time periodically

// OscillatorNode (LFO) -> GainNode (Depth) -> delayTime (AudioParam)

lfo.connect(depth);

depth.connect(delay.delayTime);

// Start oscillator and LFO immediately

oscillator.start(0);

lfo.start(0);

buttonElement.textContent = 'stop';

});

buttonElement.addEventListener('mouseup', (event) => {

if ((oscillator === null) || (lfo === null)) {

return;

}

// Stop immediately

oscillator.stop(0);

lfo.stop(0);

// GC (Garbage Collection)

oscillator = null;

lfo = null;

buttonElement.textContent = 'start';

});

rangeDelayTimeElement.addEventListener('input', (event) => {

delay.delayTime.value = event.currentTarget.valueAsNumber * 0.001;

depth.gain.value = delay.delayTime.value * depthRate;

spanPrintDelayTimeElement.textContent = `${Math.trunc(delay.delayTime.value * 1000)} msec`;

});

rangeDepthElement.addEventListener('input', (event) => {

depthRate = event.currentTarget.valueAsNumber;

depth.gain.value = delay.delayTime.value * depthRate;

spanPrintDepthElement.textContent = depthRate.toString(10);

});

rangeRateElement.addEventListener('input', (event) => {

rateValue = event.currentTarget.valueAsNumber;

if (lfo) {

lfo.frequency.value = rateValue;

}

spanPrintRateElement.textContent = rateValue.toString(10);

});

rangeMixElement.addEventListener('input', (event) => {

mixValue = event.currentTarget.valueAsNumber;

dry.gain.value = 1 - mixValue;

wet.gain.value = mixValue;

spanPrintMixElement.textContent = mixValue.toString(10);

});

rangeFeedbackElement.addEventListener('input', (event) => {

const feedbackValue = event.currentTarget.valueAsNumber;

feedback.gain.value = feedbackValue;

spanPrintFeedbackElement.textContent = feedbackValue.toString(10);

});

ディレイタイムの周期的な変化とFM 変調

FM 変調 (Frequency Modulation ) とは, 時間の経過とともに信号の周波数を変化させることです.

Time Domain

Frequency Domain (Spectrum)

FM 変調のイメージ (スペクトルのピークが 880 Hz ± 440 Hz の間で変調します)

start

コーラス・フランジャーは, 結果的に FM 変調を発生させていると解説しましたが, これに対して疑問に思うことがあるかもしれません.

周波数を周期的に変化させるために, なぜ, ディレイタイムを周期的に変化させているのかということです

(ディレイタイムの周期的な変化が原理となっているかということです) LFO の実装例 で解説したように,

直接的に周波数を周期的に変化させればよいはずです. しかしながら, 基本波形のように, 基本周波数が明確な場合はそれで問題ないのですが, アンサンブル

(つまり, 楽曲) や音声において, 一般的に, 基本周波数を (精度高く) 推定するアルゴリズムは複雑になりますし, それにともなって計算量も多くなります

(ちなみに, $f_{0}$ 推定などと呼ばれます). つまり, 汎用的なコーラス・フランジャーを実装するとなると,

直接的に周波数を変化させることは難しくなります.

ここで, コンボリューション積分とフーリエ変換の性質から,

時間領域における遅延は, 周波数領域においては周波数成分の変化となります (数学的な詳細を知る必要はないですが,

巡回畳み込み のセクションが参考になると思います). すなわち,

時間領域においてディレイタイムを周期的に変化させることは, 周波数領域において各周波数成分を周期的に変化させる こととなり, 結果として

(汎用的な) FM 変調となります.

ちなみに, すでにサンプルコードを実行して気づいたかもしれませんが,

コーラス・フランジャーで, エフェクト音のみの出力にした場合, ビブラートとなります . ビブラートはまさに FM 変調であり, 言い換えれば,

コーラス・フランジャーは, ビブラートをベースにしたエフェクターであり, 汎用的な実装とパラメータ設定でビブラートにすることも可能ということです.

フェイザー

フェイザー は, (テキストでは表現しにくいですが) シュワシュワという独特な感じのエフェクトを与えます. パラメータの設定しだいでは,

フランジャーっぽい感じにもなります. 実際, 楽曲を聴くと, フェイザーかフランジャーを使っているかは判断ができないぐらい似ているエフェクターです.

フランジャーに似ているエフェクトでありながら, その原理はまったく異なります. フェイザーは, 特定の周波数帯域の音の位相 を周期的に変化させて,

原音と合成して, 音を干渉 させることによって実装できるエフェクターです. ちなみに, フェイザーの正式な名称は, フェイズ・シフター であり,

まさに, 名称がその原理を表していると言えます.

位相

位相 とは, 時間領域における波の位置のことです (数学的には, ある時刻の複素数平面における偏角と考えることもできます). したがって,

周期性をもつ波の場合, 位相はその周期内の値だけを考慮すれば事足ります (正弦波の場合,

$\sin\theta = \sin\left(\theta + 2\pi\right) = \sin\left(\theta + 4\pi\right) = \cdots = \sin\left(\theta + 2n\pi\right)$

となるので, $2\pi$ の区間の位相を考慮すればよいことになります). また, 正弦波と余弦波は位相の違いでしかありません

($\sin\theta = \cos\left(\theta - \frac{\pi}{2}\right)$ . これは, 位相で考えなくても,

加法定理で数式から導出できることでもあります).

位相 (例: $\theta = \frac{\pi}{4}$ の場合)

位相と周期性から, 位相の変化をイメージすると, 横軸を位相 (単位は radian: ラジアン) としたときに, 以下のような変化になります.

位相変化のイメージ

start

$+\frac{\pi}{2}$

正弦波の場合, $\frac{\pi}{2}$ シフトすると反転した余弦波,

$\pi$ シフトすると反転した自身の波 (反転した正弦波),

$\frac{3\pi}{2}$ シフトすると余弦波, $2\pi$ シフトすると元の正弦波に戻ります.

フェイザーの原理を理解するうえで, この位相変化のイメージは重要になるのでおさえておいてください.

All-Pass Filter

フェイザーは, 位相を変化させる周波数帯域を周期的に変化させて, 原音と合成して音を干渉させることによって実装できます. つまり,

位相を変化させる ことがフェイザーにとって重要な処理となりますが, All-Pass Filter を使うことで,

対象の周波数成分の位相を変化させることができます (他のフィルタと異なり, すべての周波数成分のゲイン (振幅) を変化させずに通過させるので,

オールパス という名前がついています).

Web Audio API では, BiquadFilterNode インスタンスの type プロパティに 'allpass' を設定することで,

簡単に All-Pass Filter を使うことができます.

const context = new AudioContext();

const oscillator = new OscillatorNode(context, { type: 'sawtooth' });

const allpass = new BiquadFilterNode(context, { type: 'allpass', frequency: 880 });

oscillator.connect(allpass);

allpass.connect(context.destination);

oscillator.start(0);

oscillator.stop(context.currentTime + 2);

位相変化と干渉

ところで, All-Pass Filter を通過させた音, つまり, 位相を変化させただけの音というのは, 特に変化を知覚することはできません.

スペクトル のセクションでも記載しましたが, 人間の聴覚というのは位相の違いには鈍感 だからです. では, なぜ,

フェイザーはエフェクトとして知覚することができるのでしょうか ?

フェイザーは, 位相の変化を知覚しているのではなく, 位相を変化させたエフェクト音と原音を合成することで音波を干渉 させて, 結果として発生する,

振幅の増減やうねり を知覚しているからです.

位相変化と干渉のイメージ

start

$+\frac{\pi}{2}$

上記の正弦波で説明すると, 開始時刻において, 原音とエフェクト音 (ともに, 半透明の青色の波) は, 同じ位相にあります. ここで,

$\theta = \frac{\pi}{2}$ の位相の点に着目すると, 同じ位相なので, 音波が重なり, 合成された結果, 出力音 (マゼンタ色の波) は

$0.5 \cdot \sin\left(\frac{\pi}{2}\right) + 0.5 \cdot \sin\left(\frac{\pi}{2}\right) = 1$

となって振幅が増幅します. エフェクト音の位相を $\frac{\pi}{2}$ ずらすと, 反転した余弦波となり, 位相

$\theta = \frac{\pi}{2}$ でのエフェクト音は

$-0.5 \cdot \cos\left(\frac{\pi}{2}\right) = 0$ となるので, 合成された結果, 出力音の振幅値は,

$0.5 \cdot \sin\left(\frac{\pi}{2}\right) - 0.5\cdot \cos\left(\frac{\pi}{2}\right) = 0.5$ となります. さらに,

エフェクト音の位相を $\frac{\pi}{2}$ (開始時刻を基準にすると, $\pi$ ) ずらすと,

反転した正弦波となり, 位相 $\theta = \frac{\pi}{2}$ でのエフェクト音は

$-0.5 \cdot \sin\left(\frac{\pi}{2}\right) = -0.5$ となるので, 合成された結果の振幅値は,

$0.5 \cdot \sin\left(\frac{\pi}{2}\right) - 0.5 \cdot \sin\left(\frac{\pi}{2}\right) = 0$ となります (位相

$\theta = \frac{\pi}{2}$ に限らず, 反転した正弦波と合成するので, すべての位相においてその振幅は

0 であり, すなわち, 無音となります). そして, エフェクト音の位相を 1 周期分, つまり, $2\pi$ ずらすと,

エフェクト音は再び元の位相に戻るので, 開始時刻と同様の出力音となります.

周期関数なので, 1 周期分以上の位相の変化 ($2\pi$ 以上の位相の変化) においては, 同様の振幅の増減の現象が繰り返し発生します.

このように, 複数の音波を合成した結果, 生じる振幅の増減現象を干渉 と呼びます (実は, これまでも, エフェクターの解説で実装した,

原音とエフェクト音を合成する処理というのも, 物理的な視点では, 音波の干渉です. 音楽的には, このような音を重ねる処理を, 合成, あるいは,

ミキシングと呼ぶので, 合成という用語を優先して使いました).

また, 位相がわずかに異なる時点で音波を重ねることをうねり (うなりとも呼びます) と呼び, 音楽的な効果が高いことが知られています (同様に,

周波数をわずかにずらした音波を重ねた場合でもうねり現象は発生します. 実は, これが原始的なコーラスでもあります).

したがって, 位相を変化させたエフェクト音と原音を合成するような AudioNode の接続を実装すると以下のようになります.

const context = new AudioContext();

const oscillator = new OscillatorNode(context, { type: 'sawtooth' });

const allpass = new BiquadFilterNode(context, { type: 'allpass', frequency: 880 });

// Connect nodes for original sound

// OscillatorNode (Input) -> AudioDestinationNode (Output)

oscillator.connect(context.destination);

// Connect nodes for shifting phase

// OscillatorNode (Input) -> BiquadFilterNode (All-Pass Filter) -> AudioDestinationNode (Output)

oscillator.connect(allpass);

allpass.connect(context.destination);

oscillator.start(0);

oscillator.stop(context.currentTime + 2);

ところが, この実装では, 位相を変化する周波数成分が固定されたままなので, 干渉による振幅の増減変化が知覚できるほど発生しないので,

フェイザーとして聴こえません. 位相変化させる周波数成分を周期的に変化させるように, LFO を All-Pass Filter の frequency プロパティ

(AudioParam) に接続します.

const context = new AudioContext();

const baseFrequency = 880;

const depthValue = 220;

const rateValue = 1;

const oscillator = new OscillatorNode(context, { type: 'sawtooth' });

const allpass = new BiquadFilterNode(context, { type: 'allpass', frequency: baseFrequency });

const lfo = new OscillatorNode(context, { frequency: rateValue });

const depth = new GainNode(context, { gain: depthValue });

// Connect nodes for original sound

// OscillatorNode (Input) -> AudioDestinationNode (Output)

oscillator.connect(context.destination);

// Connect nodes for shifting phase

// OscillatorNode (Input) -> BiquadFilterNode (All-Pass Filter) -> AudioDestinationNode (Output)

oscillator.connect(allpass);

allpass.connect(context.destination);

// Connect nodes for LFO that changes All-Pass Filter frequency periodically

// OscillatorNode (LFO) -> GainNode (Depth) -> frequency (AudioParam)

lfo.connect(depth);

depth.connect(allpass.frequency);

// Start oscillator and LFO

oscillator.start(0);

lfo.start(0);

// Stop oscillator and LFO

oscillator.stop(context.currentTime + 5);

lfo.stop(context.currentTime + 5);

これで, 位相を変化させた音と干渉によって生じる振幅の増減, つまり, フェイザーのエフェクト音を知覚できるようになったと思います. あとは,

コーラスやフランジャーと同様に, 原音とエフェクト音のゲインを制御できるように, Dry / Wet のための GainNode を接続します.

const context = new AudioContext();

const baseFrequency = 880;

const depthValue = 220;

const rateValue = 1;

const oscillator = new OscillatorNode(context, { type: 'sawtooth' });

const allpass = new BiquadFilterNode(context, { type: 'allpass', frequency: baseFrequency });

const lfo = new OscillatorNode(context, { frequency: rateValue });

const depth = new GainNode(context, { gain: depthValue });

const dry = new GainNode(context, { gain: 0.5 }); // for gain of original sound

const wet = new GainNode(context, { gain: 0.5 }); // for gain of phaser sound

// Connect nodes for original sound

// OscillatorNode (Input) -> GainNode (Dry) -> AudioDestinationNode (Output)

oscillator.connect(dry);

dry.connect(context.destination);

// Connect nodes for shifting phase

// OscillatorNode (Input) -> BiquadFilterNode (All-Pass Filter) -> GainNode (Wet) -> AudioDestinationNode (Output)

oscillator.connect(allpass);

allpass.connect(wet);

wet.connect(context.destination);

// Connect nodes for LFO that changes All-Pass Filter frequency periodically

// OscillatorNode (LFO) -> GainNode (Depth) -> frequency (AudioParam)

lfo.connect(depth);

depth.connect(allpass.frequency);

// Start oscillator and LFO

oscillator.start(0);

lfo.start(0);

// Stop oscillator and LFO

oscillator.stop(context.currentTime + 5);

lfo.stop(context.currentTime + 5);

現実世界のフェイザーは, よりアグレッシブな干渉を発生させるために, All-Pass Filter を複数接続します. 2 個, 4 個, 12 個, 24

個の接続可能なフェイザーが多く, それらは, All-Pass Filter の接続数 $n$ 個によって,

$n$ 段フェイザー

以下は, All-Pass Filter を 4 つ接続したフェイザー (4 段フェイザー) の実装です. 1 つだけの接続の場合より, 干渉による変化が大きく聴こえると思います.

const context = new AudioContext();

const baseFrequency = 880;

const depthValue = 220;

const rateValue = 1;

const oscillator = new OscillatorNode(context, { type: 'sawtooth' });

const allpasses = [

new BiquadFilterNode(context, { type: 'allpass', frequency: baseFrequency }),

new BiquadFilterNode(context, { type: 'allpass', frequency: baseFrequency }),

new BiquadFilterNode(context, { type: 'allpass', frequency: baseFrequency }),

new BiquadFilterNode(context, { type: 'allpass', frequency: baseFrequency })

];

const lfo = new OscillatorNode(context, { frequency: rateValue });

const depth = new GainNode(context, { gain: depthValue });

const dry = new GainNode(context, { gain: 0.5 }); // for gain of original sound

const wet = new GainNode(context, { gain: 0.5 }); // for gain of phaser sound

// Connect nodes for original sound

// OscillatorNode (Input) -> GainNode (Dry) -> AudioDestinationNode (Output)

oscillator.connect(dry);

dry.connect(context.destination);

// Connect nodes for shifting phase

// OscillatorNode (Input) -> BiquadFilterNode (All-Pass Filter) x 4 -> GainNode (Wet) -> AudioDestinationNode (Output)

oscillator.connect(allpasses[0]);

for (let i = 0; i < 3; i++) {

allpasses[i].connect(allpasses[i + 1]);

}

allpasses[3].connect(wet);

wet.connect(context.destination);

// Connect nodes for LFO that changes All-Pass Filter frequency periodically

// OscillatorNode (LFO) -> GainNode (Depth) -> frequency (AudioParam)

lfo.connect(depth);

for (let i = 0; i < 4; i++) {

depth.connect(allpasses[i].frequency);

}

// Start oscillator and LFO

oscillator.start(0);

lfo.start(0);

// Stop oscillator and LFO

oscillator.stop(context.currentTime + 5);

lfo.stop(context.currentTime + 5);

フェイザーのノード接続図 (4 段フェイザー)

さらに, アグレッシブなエフェクトを発生させたい場合は, フィードバック接続を追加することも考えられます (ただし, フェイザーにおいて,

フィードバックは一般的に必須というわけではありません). また, レゾナンス (BiquadFilterNode の Q プロパティ

(AudioParam)) を変更可能にすると, フェイザーによりバリエーションを付加することができます (BiquadFilterNode の

Q プロパティは, type プロパティ (フィルタの種類) によって制御しているフィルタの特性が異なるので, 詳細はフィルタのセクション で解説します).

以下は, 実際のアプリケーションを想定して, ユーザーインタラクティブに, All-Pass Filter の接続数や,

位相変化させる周波数成分などフェイザーに関わるパラメータを制御できるようにしたコード例です. フェイザーはその原理から,

エフェクト音のみでは変化を得ることができないので, Mix の値が 1 未満になるように上限を設定していることにも着目してください.

<button type="button">start</button>

<select id="select-phaser-stages">

<option value="2">2 stages</option>

<option value="4" selected >4 stages</option>

<option value="8">8 stages</option>

<option value="12">12 stages</option>

<option value="24">24 stages</option>

</select>

<label for="range-phaser-frequency">Frequency</label>

<input type="range" id="range-phaser-frequency" value="880" min="100" max="4000" step="1" />

<span id="print-phaser-frequency-value">880 Hz</span>

<label for="range-phaser-depth">Depth</label>

<input type="range" id="range-phaser-depth" value="0" min="0" max="1" step="0.05" />

<span id="print-phaser-depth-value">0</span>

<label for="range-phaser-rate">Rate</label>

<input type="range" id="range-phaser-rate" value="0" min="0" max="10" step="0.5" />

<span id="print-phaser-rate-value">0</span>

<label for="range-phaser-resonance">Resonance</label>

<input type="range" id="range-phaser-resonance" value="1" min="1" max="20" step="1" />

<span id="print-phaser-resonance-value">1</span>

<label for="range-phaser-mix">Mix</label>

<input type="range" id="range-phaser-mix" value="0" min="0" max="0.9" step="0.05" />

<span id="print-phaser-mix-value">0</span>const context = new AudioContext();

let oscillator = null;

let lfo = null;

let numberOfStages = 4;

let baseFrequency = 880;

let depthRate = 0;

let rateValue = 0;

let resonance = 1;

let mixValue = 0;

const allpasses = [

new BiquadFilterNode(context, { type: 'allpass', frequency: baseFrequency }),

new BiquadFilterNode(context, { type: 'allpass', frequency: baseFrequency }),

new BiquadFilterNode(context, { type: 'allpass', frequency: baseFrequency }),

new BiquadFilterNode(context, { type: 'allpass', frequency: baseFrequency })

];

const depth = new GainNode(context, { gain: baseFrequency * depthRate });

const dry = new GainNode(context, { gain: 1 - mixValue });

const wet = new GainNode(context, { gain: mixValue });

const buttonElement = document.querySelector('button[type="button"]');

const selectPhaserStagesElement = document.getElementById('select-phaser-stages');

const rangeFrequencyElement = document.getElementById('range-phaser-frequency');

const rangeDepthElement = document.getElementById('range-phaser-depth');

const rangeRateElement = document.getElementById('range-phaser-rate');

const rangeResonanceElement = document.getElementById('range-phaser-resonance');

const rangeMixElement = document.getElementById('range-phaser-mix');

const spanPrintFrequencyElement = document.getElementById('print-phaser-frequency-value');

const spanPrintDepthElement = document.getElementById('print-phaser-depth-value');

const spanPrintRateElement = document.getElementById('print-phaser-rate-value');

const spanPrintResonanceElement = document.getElementById('print-phaser-resonance-value');

const spanPrintMixElement = document.getElementById('print-phaser-mix-value');

buttonElement.addEventListener('mousedown', (event) => {

if ((oscillator !== null) || (lfo !== null)) {

return;

}

oscillator = new OscillatorNode(context, { type: 'sawtooth' });

lfo = new OscillatorNode(context, { frequency: rateValue });

// Connect nodes for original sound

// OscillatorNode (Input) -> GainNode (Dry) -> AudioDestinationNode (Output)

oscillator.connect(dry);

dry.connect(context.destination);

// Connect nodes for shifting phase

// OscillatorNode (Input) -> BiquadFilterNode (All-Pass Filter) x N -> GainNode (Wet) -> AudioDestinationNode (Output)

oscillator.connect(allpasses[0]);

for (let i = 0; i < (numberOfStages - 1); i++) {

allpasses[i].connect(allpasses[i + 1]);

}

allpasses[numberOfStages - 1].connect(wet);

wet.connect(context.destination);

// Connect nodes for LFO that changes All-Pass Filter frequency periodically

// OscillatorNode (LFO) -> GainNode (Depth) -> frequency (AudioParam)

lfo.connect(depth);

for (let i = 0; i < numberOfStages; i++) {

depth.connect(allpasses[i].frequency);

}

// Start oscillator and LFO immediately

oscillator.start(0);

lfo.start(0);

buttonElement.textContent = 'stop';

});

buttonElement.addEventListener('mouseup', (event) => {

if ((oscillator === null) || (lfo === null)) {

return;

}

// Stop immediately

oscillator.stop(0);

lfo.stop(0);

// GC (Garbage Collection)

oscillator = null;

lfo = null;

buttonElement.textContent = 'start';

});

selectPhaserStagesElement.addEventListener('change', (event) => {

numberOfStages = Number(event.currentTarget.value);

for (let i = 0, len = allpasses.length; i < len; i++) {

allpasses[i].disconnect(0);

}

for (let i = 0; i < numberOfStages; i++) {

allpasses[i] = new BiquadFilterNode(context, { type: 'allpass', frequency: baseFrequency });

}

if (oscillator !== null) {

oscillator.connect(allpasses[0]);

}

for (let i = 0; i < (numberOfStages - 1); i++) {

allpasses[i].connect(allpasses[i + 1]);

}

allpasses[numberOfStages - 1].connect(wet);

wet.connect(context.destination);

for (let i = 0; i < numberOfStages; i++) {

depth.connect(allpasses[i].frequency);

}

});

rangeFrequencyElement.addEventListener('input', (event) => {

baseFrequency = event.currentTarget.valueAsNumber;

for (let i = 0; i < numberOfStages; i++) {

allpasses[i].frequency.value = baseFrequency;

}

spanPrintFrequencyElement.textContent = `${Math.trunc(baseFrequency)} Hz`;

});

rangeDepthElement.addEventListener('input', (event) => {

depthRate = event.currentTarget.valueAsNumber;

depth.gain.value = baseFrequency * depthRate;

spanPrintDepthElement.textContent = depthRate.toString(10);

});

rangeRateElement.addEventListener('input', (event) => {

rateValue = event.currentTarget.valueAsNumber;

if (lfo) {

lfo.frequency.value = rateValue;

}

spanPrintRateElement.textContent = rateValue.toString(10);

});

rangeResonanceElement.addEventListener('input', (event) => {

resonance = event.currentTarget.valueAsNumber;

for (let i = 0; i < numberOfStages; i++) {

allpasses[i].Q.value = resonance;

}

spanPrintResonanceElement.textContent = resonance.toString(10);

});

rangeMixElement.addEventListener('input', (event) => {

mixValue = event.currentTarget.valueAsNumber;

dry.gain.value = 1 - mixValue;

wet.gain.value = mixValue;

spanPrintMixElement.textContent = mixValue.toString(10);

});

トレモロ・リングモジュレーター

トレモロ は, 音の大きさに揺らぎを与えるエフェクターです. ギターでは素早くピッキングを繰り返して,

音が震えているように奏でるトレモロ奏法があります. トレモロは, トレモロ奏法をオーディオ信号処理によって実現するエフェクターとも言えます (ギターでは,

もう 1 つトレモロという名称がついているものがあります. ストラトキャスター (タイプ) のギターに搭載されているトレモロアームです. しかし,

トレモロアームは, ビブラートの効果を与えるものなので, 同じトレモロという名称ですが, 効果としては別なものです).

リングモジュレーター は, 金属的な音色に変化させるエフェクトです. 例えば, ピアノにリングモジュレーターをかけると, 鐘のような音色に変化します.

エフェクターとして, トレモロとリングモジュレーターはかなり感じが違いますが, 原理は共通しています. その原理とは,

AM 変調 を利用したエフェクターであることです.

トレモロ

トレモロは振幅 (音の大きさ) を周期的に変化させることによって, 実装することができます. つまり, LFO を, GainNode の

gain プロパティ (AudioParam) に接続することによって実装できます. トレモロは, これまで解説したディレイ・リバーブ,

コーラス・フランジャー, フェイザーなどと異なり, 原音を変化させるので, AudioNode の接続も実装も非常にシンプルです (トレモロのようのな,

原音を直接変化させるエフェクターをインサートエフェクト と呼ぶことがあります).

トレモロのノード接続図

const context = new AudioContext();

const depthValue = 0.25;

const rateValue = 2.5;

const amplitude = new GainNode(context, { gain: 0.5 }); // 0.5 +- ${depthValue}

const oscillator = new OscillatorNode(context);

const lfo = new OscillatorNode(context, { frequency: rateValue });

const depth = new GainNode(context, { gain: depthValue });

// Connect nodes

// OscillatorNode (Input) -> GainNode (Amplitude) -> AudioDestinationNode (Output)

oscillator.connect(amplitude);

amplitude.connect(context.destination);

// Connect nodes for LFO that changes gain periodically

// OscillatorNode (LFO) -> GainNode (Depth) -> gain (AudioParam)

lfo.connect(depth);

depth.connect(amplitude.gain);

// Start oscillator and LFO

oscillator.start(0);

lfo.start(0);

// Stop oscillator and LFO

oscillator.stop(context.currentTime + 5);

lfo.stop(context.currentTime + 5);

トレモロは, 振幅 1 を基準に値が変化するように定義されています ($f_{s}$ はサンプリング周波数).

しかしながら, そのまま実装すると, 実際には音割れ (クリッピング) が発生してしまうので, 実装では, 0.5 を基準に, Depth

の値が増減するようにしています.

$y\left(n\right) = \left(1 + \mathrm{depth} \cdot \sin\left(\frac{2\pi \cdot \mathrm{rate} \cdot n}{f_{s}}\right)\right) \cdot x\left(n\right)$

以下は, 実際のアプリケーションを想定して, ユーザーインタラクティブに, トレモロに関わるパラメータを制御できるようにしたコード例です.

トレモロのような (他には, コンプレッサーやディストーションなど) インサートエフェクトでは, パラメータの制御のみでエフェクターを OFF

にする場合が難しい場合もあるので, コード例のように, フラグなどに応じて, AudioNode の接続自体を切り替えるような実装が必要になります

(もっとも, トレモロの場合, Depth を 0 に設定することで, 原音をそのまま出力することが可能です).

<button type="button">start</button>

<label>

<input type="checkbox" id="checkbox-tremolo" checked />

<span id="print-checked-tremolo">ON</span>

</label>

<label for="range-tremolo-depth">Depth</label>

<input type="range" id="range-tremolo-depth" value="0" min="0" max="1" step="0.05" />

<span id="print-tremolo-depth-value">0</span>

<label for="range-tremolo-rate">Rate</label>

<input type="range" id="range-tremolo-rate" value="0" min="0" max="10" step="0.5" />

<span id="print-tremolo-rate-value">0</span>const context = new AudioContext();

let depthRate = 0;

let rateValue = 0;

let oscillator = new OscillatorNode(context);

let lfo = new OscillatorNode(context, { frequency: rateValue });

let isStop = true;

const amplitude = new GainNode(context, { gain: 0.5 }); // 0.5 +- ${depthValue}

const depth = new GainNode(context, { gain: amplitude.gain.value * depthRate });

const buttonElement = document.querySelector('button[type="button"]');

const checkboxElement = document.querySelector('input[type="checkbox"]');

const rangeDepthElement = document.getElementById('range-tremolo-depth');

const rangeRateElement = document.getElementById('range-tremolo-rate');

const spanPrintCheckedElement = document.getElementById('print-checked-tremolo');

const spanPrintDepthElement = document.getElementById('print-tremolo-depth-value');

const spanPrintRateElement = document.getElementById('print-tremolo-rate-value');

checkboxElement.addEventListener('click', () => {

oscillator.disconnect(0);

amplitude.disconnect(0);

lfo.disconnect(0);

if (checkboxElement.checked) {

// Connect nodes

// OscillatorNode (Input) -> GainNode (Amplitude) -> AudioDestinationNode (Output)

oscillator.connect(amplitude);

amplitude.connect(context.destination);

// Connect nodes for LFO that changes gain periodically

// OscillatorNode (LFO) -> GainNode (Depth) -> gain (AudioParam)

lfo.connect(depth);

depth.connect(amplitude.gain);

spanPrintCheckedElement.textContent = 'ON';

} else {

// OscillatorNode (Input) -> AudioDestinationNode (Output)

oscillator.connect(context.destination);

spanPrintCheckedElement.textContent = 'OFF';

}

});

buttonElement.addEventListener('mousedown', () => {

if (!isStop) {

return;

}

if (checkboxElement.checked) {

// Connect nodes

// OscillatorNode (Input) -> GainNode (Amplitude) -> AudioDestinationNode (Output)

oscillator.connect(amplitude);

amplitude.connect(context.destination);

// Start oscillator

oscillator.start(0);

} else {

amplitude.disconnect(0);

// Connect nodes (Tremolo OFF)

// OscillatorNode (Input) -> AudioDestinationNode (Output)

oscillator.connect(context.destination);

// Start oscillator

oscillator.start(0);

}

// Connect nodes for LFO that changes gain periodically

// OscillatorNode (LFO) -> GainNode (Depth) -> gain (AudioParam)

lfo.connect(depth);

depth.connect(amplitude.gain);

lfo.start(0);

isStop = false;

buttonElement.textContent = 'stop';

});

buttonElement.addEventListener('mouseup', () => {

if (isStop) {

return;

}

// Stop immediately

oscillator.stop(0);

lfo.stop(0);

oscillator = new OscillatorNode(context);

lfo = new OscillatorNode(context, { frequency: rateValue });

isStop = true;

buttonElement.textContent = 'start';

});

rangeDepthElement.addEventListener('input', (event) => {

depthRate = event.currentTarget.valueAsNumber;

depth.gain.value = amplitude.gain.value * depthRate;

spanPrintDepthElement.textContent = depthRate.toString(10);

});

rangeRateElement.addEventListener('input', (event) => {

rateValue = event.currentTarget.valueAsNumber;

if (lfo) {

lfo.frequency.value = rateValue;

}

spanPrintRateElement.textContent = rateValue.toString(10);

});

リンクモジュレーター

リングモジュレーター は, AudioNode の接続としてはトレモロと同じです. LFO の Rate (変調の周波数)を, およそ

100 Hz 以上にしていくと, 原音の周波数成分とは異なる周波数成分が発生するようになります.

この周波数成分が金属的な音を生み出す要因となって, 原理は同じながらも, トレモロとは異なるエフェクトを得ることができます.

リングモジュレーターのノード接続図

リングモジュレーターは, 原音の振幅を正弦波で変調するように定義されているので, トレモロと異なり, 基準となる gain プロパティの値は

0 を設定しています.

$y\left(n\right) = \left(\mathrm{depth} \cdot \sin\left(\frac{2\pi \cdot \mathrm{rate} \cdot n}{f_{s}}\right)\right) \cdot x\left(n\right)$

以下は, 同様に実際のアプリケーションを想定して, ユーザーインタラクティブに,

リングモジュレーターに関わるパラメータを制御できるようにしたコード例です. 定義式にしたがって, 基準となる gain プロパティの値を

0 にしていること, また, Rate がトレモロより高い値に設定できるようにしていることに着目してください.

<button type="button">start</button>

<label>

<input type="checkbox" id="checkbox-ringmodulator" checked />

<span id="print-checked-ringmodulator">ON</span>

</label>

<label for="range-ringmodulator-depth">Depth</label>

<input type="range" id="range-ringmodulator-depth" value="1" min="0" max="1" step="0.05" />

<span id="print-ringmodulator-depth-value">1</span>

<label for="range-ringmodulator-rate">Rate</label>

<input type="range" id="range-ringmodulator-rate" value="1000" min="0" max="2000" step="100" />

<span id="print-ringmodulator-rate-value">1000</span>const context = new AudioContext();

let depthRate = 1;

let rateValue = 1000;

let oscillator = new OscillatorNode(context);

let lfo = new OscillatorNode(context, { frequency: rateValue });

let isStop = true;

const amplitude = new GainNode(context, { gain: 0 }); // 0 +- ${depthValue}

const depth = new GainNode(context, { gain: depthRate });

const buttonElement = document.querySelector('button[type="button"]');

const checkboxElement = document.querySelector('input[type="checkbox"]');

const rangeDepthElement = document.getElementById('range-ringmodulator-depth');

const rangeRateElement = document.getElementById('range-ringmodulator-rate');

const spanPrintCheckedElement = document.getElementById('print-checked-ringmodulator');

const spanPrintDepthElement = document.getElementById('print-ringmodulator-depth-value');

const spanPrintRateElement = document.getElementById('print-ringmodulator-rate-value');

checkboxElement.addEventListener('click', () => {

oscillator.disconnect(0);

amplitude.disconnect(0);

lfo.disconnect(0);

if (checkboxElement.checked) {

// Connect nodes

// OscillatorNode (Input) -> GainNode (Amplitude) -> AudioDestinationNode (Output)

oscillator.connect(amplitude);

amplitude.connect(context.destination);

// Connect nodes for LFO that changes gain periodically

// OscillatorNode (LFO) -> GainNode (Depth) -> gain (AudioParam)

lfo.connect(depth);

depth.connect(amplitude.gain);

spanPrintCheckedElement.textContent = 'ON';

} else {

// OscillatorNode (Input) -> AudioDestinationNode (Output)

oscillator.connect(context.destination);

spanPrintCheckedElement.textContent = 'OFF';

}

});

buttonElement.addEventListener('mousedown', () => {

if (!isStop) {

return;

}

if (checkboxElement.checked) {

// Connect nodes

// OscillatorNode (Input) -> GainNode (Amplitude) -> AudioDestinationNode (Output)

oscillator.connect(amplitude);

amplitude.connect(context.destination);

// Start oscillator

oscillator.start(0);

} else {

amplitude.disconnect(0);

// Connect nodes (Ring Modulator OFF)

// OscillatorNode (Input) -> AudioDestinationNode (Output)

oscillator.connect(context.destination);

// Start oscillator

oscillator.start(0);

}

// Connect nodes for LFO that changes gain periodically

// OscillatorNode (LFO) -> GainNode (Depth) -> gain (AudioParam)

lfo.connect(depth);

depth.connect(amplitude.gain);

lfo.start(0);

isStop = false;

buttonElement.textContent = 'stop';

});

buttonElement.addEventListener('mouseup', () => {

if (isStop) {

return;

}

// Stop immediately

oscillator.stop(0);

lfo.stop(0);

oscillator = new OscillatorNode(context);

lfo = new OscillatorNode(context, { frequency: rateValue });

isStop = true;

buttonElement.textContent = 'start';

});

rangeDepthElement.addEventListener('input', (event) => {

depthRate = event.currentTarget.valueAsNumber;

depth.gain.value = depthRate;

spanPrintDepthElement.textContent = depthRate.toString(10);

});

rangeRateElement.addEventListener('input', (event) => {

rateValue = event.currentTarget.valueAsNumber;

if (lfo) {

lfo.frequency.value = rateValue;

}

spanPrintRateElement.textContent = rateValue.toString(10);

});

AM 変調

AM 変調 (Amplitude Modulation ) とは, 時間の経過とともに信号の振幅を変化させることです.

Time Domain

Frequency Domain (Spectrum)

AM 変調のイメージ

start

Rate

1 Hz

変調の周期を短くしていくと (LFO の Rate を高くしていくと), 原音の周波数成分だけではなく, LFO の周波数も周波数成分として発生します. これは,

原音の波形がキャリア (搬送波 ) となって, LFO の正弦波がモジュレーター となってエンベロープを形成して周波数成分となるからです

(出力音のエンベロープが正弦波になっていることに着目してください).

この仕組みを発展させた音合成が, FM シンセサイザー (FM 音源) で, キャリア (搬送波) とモジュレーターの波形を正弦波として,

それらを合成する正弦波によって定義されます ($A$ はキャリアの振幅,

$f_{c}$ はキャリアの周波数, $\beta$ は変調指数 (LFO の Depth に相当),

$f_{m}$ はモジュレーターの周波数 (LFO の Rate に相当)).

$y\left(n\right) = A \cdot \sin\left(\frac{2\pi \cdot f_{c} \cdot n}{f_{s}} + \left(\beta \cdot \sin\left(\frac{2\pi \cdot f_{m} \cdot

n}{f_{s}}\right)\right)\right)$

(命名的に混同しますが) リングモジュレーター自体の原理は AM 変調であり, それが, FM シンセサイザーの原理になっているということです.

フィルタ

フィルタという言葉は日常生活でも使われますし, コンピューターサイエンスにおいても, UNIX 系 OS でパイプとフィルタがあります. フィルタの概念としては,

ある結果を遮断して, ある結果を通過させるということでしょう.

オーディオ信号処理におけるフィルタ も同様に, ある周波数成分の音を通過・遮断, あるいは, 増幅・減衰させて, 周波数特性を変化させます.

フィルタだけをエフェクターとして使うことはあまりなく, すでに解説したフェイザーや, このあとのセクションで解説する,

イコライザーやワウなどフィルタ系のエフェクターで使われることが多いです.

また, 音響特徴量はスペクトル, つまり, 周波数成分として表れることが多いので, 音の加工においてもフィルタを理解することは重要となります.

デシベル

フィルタの解説において, 仕様上, デシベル (dB ) という単位が使われるので (BiquadFilterNode の

gain プロパティやフィルタの特性グラフなど), フィルタに限ったことではないですが, ここで解説をします.

デシベルとは, 端的には, 音圧レベル を表す単位です. 音圧 とは, 音の実体である媒体の振動によって伝わる圧力 (力) のことです.

ここで, 基準の音圧 ($P_{0} = 2 \cdot 10^{-5} \mathrm{[Pa]}$ ) を基準 (ちなみに, この基準の音圧は,

1 KHz における可聴な最小の音圧とされています) に, 対象の音の音圧 $P$ の比率の対数をとった値

(以下の定義式. 上は時間領域, 下は周波数領域での定義式. 多くのケースにおいて, 音圧パワー (音圧の 2 乗) の比を算出することが有用なので,

各音圧の 2 乗の比で定義しています) が音圧レベルとなります.

$

\begin{flalign}

&10\log_{10}\left(\frac{P}{P_{0}}\right)^{2} = 20\log_{10}\left(\frac{P}{P_{0}}\right) \quad \left(P_{0} = 2 \cdot 10^{-5} \mathrm{[Pa]}\right) \\

& \\

&10\log_{10}\left|X\left(k\right)\right|^{2} = 20\log_{10}\left|X\left(k\right)\right| \\

& \\

\end{flalign}

$

対数で表す理由は大きく 2 つあります.

音圧は非常に広範囲な値となるので, 人間の感覚とうまく対応ない

フェヒナーの法則 という心理学の理論で, 人間の感覚量は刺激強度の対数に比例する という法則が適用できる

(以下の表を参考にして) 6 dB 音圧レベルが大きくなれば音圧は約 2 倍 ($20\log_{10}2$ ) になります.

20 dB が大きくなれば 10 倍 ($20\log_{10}10$ ), 40 dB 大きくなれば 100 倍 ($20\log_{10}100$ ) ... という関係で, 本来であれば広範囲におよぶ値を対数をとることによって解決しています.

デシベル差と倍率

Difference decibel

Magnification

Example

0 dB

1 倍

人間の聴力の限界

6 dB

2 倍

10 dB

3 倍

20 dB

10 倍

木の葉のふれあう音

40 dB

100 倍

図書館

60 dB

1,000 倍

会話

80 dB

10,000 倍

目覚まし時計

100 dB

100,000 倍

電車のガード下

120 dB

1,000,000 倍

飛行機のエンジン付近

フィルタの特性を表すグラフでは, 0 dB を基準に見ていただくのがよいのですが, これは,

0 dB が入力音と出力音の振幅比が変わらない (つまり, そのまま通過させる) ことを意味しているからです$20\log_{10}1 = 0$ ). これを理解しておくと, BiquadFilterNode の gain プロパティが (特定のフィルタの種類において)

ある周波数成分を増幅させたり, 減衰させたりすることも理解できると思います.

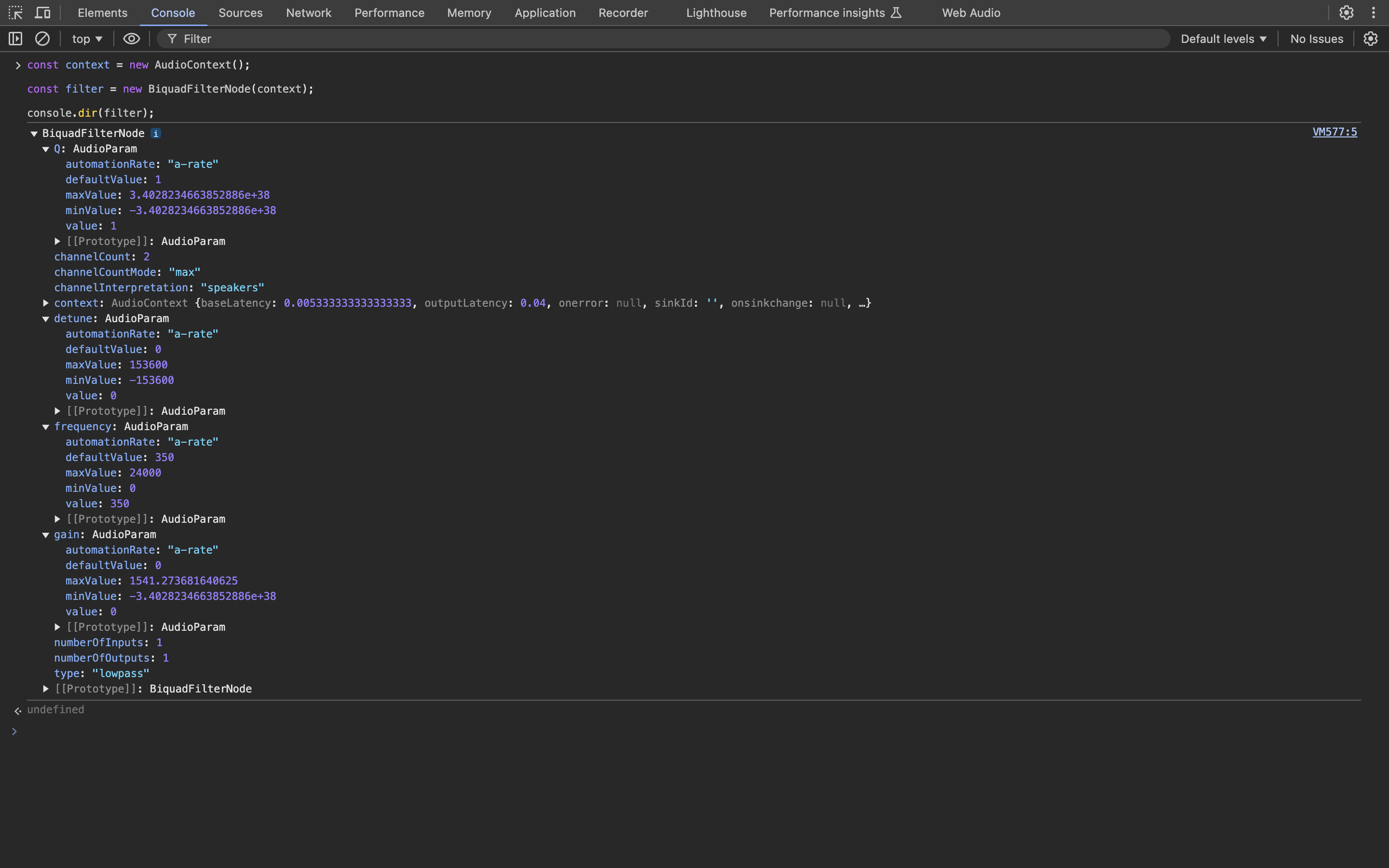

BiquadFilterNode

Web Audio API において, 様々なフィルタを簡単に利用するには BiquadFilterNode を使うのが最適です. Biquad とは,

双 2 次 という意味で, BiquadFilterNode の次数は 2 次となります (以下の伝達関数で定義されています). したがって,

BiquadFilterNode では実装できないフィルタ, 具体的には, 奇数次のフィルタを使いたい場合, あとのセクションで解説する

IIRFilterNode を使う必要があります (BiquadFilterNode は 2 次の IIR フィルタです).

BiquadFilterNode では, フィルタの特性に関わるプロパティとして, typeBiquadFilterTypefrequencydetuneAudioParam), QAudioParam), gainAudioParam) が定義されています. type プロパティ以外は,

type プロパティ (すなわち, フィルタの種類) によって, 制御するフィルタの特性が異なったり, あるいは, そもそも無効だったりするので,

BiquadFilterNode で使える 8 つのフィルタの種類ごとに解説を進めます.

フィルタの種類に関わらず, BiquadFilterNode は, そのインスタンスを接続するだけで機能します (また, コンストラクタ形式であれば,

インスタンス生成時に, 第 2 引数に BiquadFilterOptions を指定して, 初期値を変更することも可能です).

const context = new AudioContext();

const oscillator = new OscillatorNode(context, { type: 'sawtooth' });

const filter = new BiquadFilterNode(context);

// If use `createBiquadFilter`

// const filter = context.createBiquadFilter();

// OscillatorNode (Input) -> BiquadFilterNode -> AudioDestinationNode (Output)

oscillator.connect(filter);

filter.connect(context.destination);

oscillator.start(0);

frequency / detune プロパティ

フィルタの種類に関わらず, frequencydetuneOscillatorNode などと同じように, frequency プロパティと

detune プロパティを合わせて算出される周波数 ($f_{\mathrm{computed}}\left(t\right)$ )

は以下のように定義されています.

$f_{\mathrm{computed}}\left(t\right) = \mathrm{frequency}\left(t\right) \cdot \mathrm{pow}\left(2, \left(\mathrm{detune}\left(t\right) / 1200

\right)\right)$

frequency / detune プロパティ, Q プロパティ, gain プロパティは, すべて

AudioParam なので, オートメーションさせたり, LFO を接続したりすることが可能です.

BiquadFilterNode の定義式

時間領域での BiquadFilterNode の定義式 (2 次の IIR フィルタ) は, 以下のように定義されています.

$a_{0}y\left(n\right) + a_{1}y\left(n - 1\right) + a_{2}y\left(n - 2\right) = b_{0}x\left(n\right) + b_{1}x\left(n - 1\right) + b_{2}x\left(n -

2\right)$

これを $z$ 変換すると, 伝達関数 (周波数領域での BiquadFilterNode の定義式) は,

以下のように定義されます (時間領域の遅延は, $z$ 変換の次数となります).

$

\begin{flalign}

&H\left(z\right) = \frac{\frac{b_{0}}{a_{0}} + \frac{b_{1}}{a_{0}}z^{-1} + \frac{b_{2}}{a_{0}}z^{-2}}{1 + \frac{a_{1}}{a_{0}}z^{-1} + \frac{a_{2}}{a_{0}}z^{-2}}

\end{flalign}

$